Percepção da fala

A percepção da fala é o processo pelo qual os sons de uma língua são ouvidos, interpretados e compreendidos. O estudo da percepção da fala está intimamente ligado aos campos da fonologia e da fonética na linguística e da psicologia cognitiva e da percepção na psicologia. A pesquisa em percepção da fala busca compreender como os ouvintes humanos reconhecem os sons da fala e usam essas informações para compreender a linguagem falada. A pesquisa sobre percepção de fala tem aplicações na construção de sistemas de computador que possam reconhecer a fala, na melhoria do reconhecimento de fala para ouvintes com deficiência auditiva e de linguagem e no ensino de línguas estrangeiras.

O processo de percepção da fala começa ao nível do sinal sonoro e do processo de audição. Depois de processar o sinal auditivo inicial, os sons da fala são processados posteriormente para extrair sinais acústicos e informações fonéticas. Essas informações de fala podem então ser usadas para processos linguísticos de nível superior, como reconhecimento de palavras.

Pistas acústicas[editar | editar código-fonte]

As pistas acústicas são pistas sensoriais contidas no sinal sonoro da fala que são utilizadas na percepção da fala para diferenciar os sons da fala pertencentes a diferentes categorias fonéticas . Por exemplo, uma das pistas mais estudadas na fala é o tempo de início da voz ou VOT. VOT é uma dica primária que sinaliza a diferença entre oclusivas sonoras e surdas, como /b/ e /p/. Outras pistas diferenciam sons que são produzidos em diferentes locais de articulação ou modos de articulação. O sistema de fala também deve combinar essas dicas para determinar a categoria de um som de fala específico. Isto é muitas vezes pensado em termos de representações abstratas de fonemas. Essas representações podem então ser combinadas para uso no reconhecimento de palavras e em outros processos linguísticos.

Não é fácil identificar a quais sinais acústicos os ouvintes são sensíveis ao perceber um determinado som da fala:

À primeira vista, a solução para o problema de como percebemos a fala parece enganosamente simples. Se pudéssemos identificar trechos da forma de onda acústica que correspondem a unidades de percepção, então o caminho do som ao significado seria claro. Contudo, esta correspondência ou mapeamento revelou-se extremamente difícil de encontrar, mesmo depois de cerca de quarenta e cinco anos de investigação sobre o problema.[1]

Se um aspecto específico da forma de onda acústica indicasse uma unidade linguística, uma série de testes utilizando sintetizadores de voz seria suficiente para determinar tal sugestão ou sugestões. No entanto, existem dois obstáculos significativos:

- Um aspecto acústico do sinal de fala pode indicar diferentes dimensões linguisticamente relevantes. Por exemplo, a duração de uma vogal em inglês pode indicar se a vogal está ou não acentuada, ou se está em uma sílaba fechada por uma consoante sonora ou surda e, em alguns casos (como inglês americano /ɛ/ e /æ/) pode distinguir a identidade das vogais.[2] Alguns especialistas chegam a argumentar que a duração pode ajudar a distinguir o que é tradicionalmente chamado de vogais curtas e longas em inglês.[3]

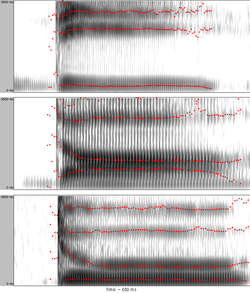

- Uma unidade linguística pode ser influenciada por diversas propriedades acústicas. Por exemplo, em um experimento clássico, Alvin Liberman (1957) mostrou que as transições do formante de início de /d/ diferem dependendo da vogal seguinte (ver Figura 1), mas todas são interpretadas como o fonema /d/ pelos ouvintes.[4]

Linearidade e segmentação da fala[editar | editar código-fonte]

Embora os ouvintes percebam a fala como um fluxo de unidades discretas (fonemas, sílabas e palavras), essa linearidade é difícil de ver no sinal físico da fala. Os sons da fala não se sucedem estritamente, mas se sobrepõem.[5] O som da fala é influenciado pelos que o precedem e pelos que se seguem. Esta influência pode até ser exercida a uma distância de dois ou mais segmentos (e através dos limites das sílabas e das palavras).[5]

Como o sinal de fala não é linear, existe um problema de segmentação. É difícil delimitar um trecho do sinal de fala como pertencente a uma única unidade perceptual. Por exemplo, as propriedades acústicas do fonema /d/ dependerão da produção da vogal seguinte (por causa da coarticulação).

Falta de invariância[editar | editar código-fonte]

A pesquisa e a aplicação da percepção da fala devem lidar com vários problemas que resultam do que foi denominado falta de invariância. É difícil encontrar relações constantes e confiáveis entre um fonema de uma língua e sua manifestação acústica na fala. Há várias razões para isso:

Variação induzida pelo ambiente[editar | editar código-fonte]

O ambiente fonético afeta as propriedades acústicas dos sons da fala. Por exemplo, /u/ em inglês é fronteado quando cercado por consoantes coronais.[6] Ou, o tempo de início da voz que marca a fronteira entre plosivas sonoras e surdas é diferente para plosivas labiais, alveolares e velares e mudam sob estresse ou dependendo da posição dentro de uma sílaba.[7]

Variação devido a diferentes condições de fala[editar | editar código-fonte]

Um fator importante que causa variação é a diferença na velocidade de fala. Muitos contrastes fonêmicos são constituídos por características temporais (vogais ou consoantes curtas versus longas, africadas versus fricativas, plosivas versus deslizamentos, plosivas sonoras versus surdas, etc.) e certamente são afetados por mudanças no andamento da fala.[1] Outra fonte importante de variação é o cuidado articulatório versus desleixo, que é típico da fala conectada (o "undershoot" articulatório é obviamente refletido nas propriedades acústicas dos sons produzidos).

Variação devido à identidade do locutor diferente[editar | editar código-fonte]

A estrutura acústica resultante das produções concretas da fala depende das propriedades físicas e psicológicas de cada falante. Homens, mulheres e crianças geralmente produzem vozes com tons diferentes. Como os falantes têm tratos vocais de tamanhos diferentes (especialmente devido ao sexo e à idade), as frequências ressonantes (formantes), que são importantes para o reconhecimento dos sons da fala, variam em seus valores absolutos entre os indivíduos.[8] A investigação mostra que os bebês com 7,5 meses de idade não conseguem reconhecer informações apresentadas por falantes de géneros diferentes; no entanto, aos 10,5 meses de idade, eles podem detectar as semelhanças.[9] O dialeto e o sotaque estrangeiro também podem causar variação, assim como as características sociais do falante e do ouvinte.[10]

Constância perceptiva e normalização[editar | editar código-fonte]

Apesar da grande variedade de falantes e de condições diferentes, os ouvintes percebem vogais e consoantes como categorias constantes. Foi proposto que isto é conseguido através do processo de normalização perceptual em que os ouvintes filtram o ruído (isto é, a variação) para chegar à categoria subjacente. As diferenças no tamanho do trato vocal resultam em variação na frequência dos formantes entre os falantes; portanto, um ouvinte deve ajustar seu sistema perceptivo às características acústicas de um falante específico. Isto pode ser conseguido considerando as proporções dos formantes em vez dos seus valores absolutos.[12][13] Este processo foi chamado de normalização do trato vocal. Da mesma forma, acredita-se que os ouvintes ajustam a percepção da duração ao ritmo atual da fala que estão ouvindo – isto tem sido referido como normalização da velocidade da fala.

Se a normalização realmente ocorre ou não e qual é a sua natureza exata é uma questão de controvérsia teórica (ver teorias abaixo). A constância perceptiva é um fenômeno que não é específico apenas da percepção da fala; existe também em outros tipos de percepção.

Percepção categórica[editar | editar código-fonte]

A percepção categórica está envolvida em processos de diferenciação perceptiva. As pessoas percebem os sons da fala de forma categórica, ou seja, são mais propensas a perceber as diferenças entre categorias (fonemas) do que dentro das categorias. O espaço perceptivo entre as categorias é, portanto, distorcido, os centros das categorias (ou "protótipos") funcionam como uma peneira[14] ou como ímãs[15] para os sons da fala que chegam.

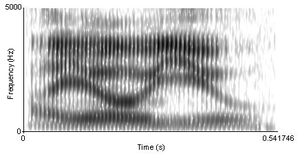

Em um continuum artificial entre uma plosiva bilabial surda e sonora, cada nova etapa difere da anterior na quantidade de VOT. O primeiro som é um [b] pré-vozeado, ou seja, tem VOT negativo. Então, aumentando o VOT, ele chega a zero, ou seja, a plosiva é um simples não aspirado surdo [p]. Gradualmente, adicionando a mesma quantidade de VOT de cada vez, a plosiva é eventualmente um bilabial surdo fortemente aspirado [pʰ] (tal continuum foi usado em um experimento por Lisker e Abramson em 1970).[16] Neste continuum de, por exemplo, sete sons, os ouvintes nativos de inglês identificarão os três primeiros sons como /b/ e os três últimos soam como /p/ com uma fronteira clara entre as duas categorias.[16] Um teste de identificação (ou categorização) com duas alternativas produzirá uma função de categorização descontínua.

Em testes de capacidade de discriminar entre dois sons com valores de VOT variados, mas com uma distância de VOT constante um do outro (20 ms, por exemplo), os ouvintes provavelmente terão um desempenho no nível do acaso se ambos os sons estiverem na mesma categoria e em quase todas as ocasiões se cada som se enquadrar em uma categoria diferente.

A conclusão a tirar tanto do teste de identificação como do teste de discriminação é que os ouvintes terão sensibilidades diferentes ao mesmo aumento relativo no VOT dependendo se a fronteira entre as categorias foi ou não ultrapassada. Ajuste perceptivo semelhante também é atestado para outras pistas acústicas.

Referências

- ↑ a b Nygaard, L.C., Pisoni, D.B. (1995). «Speech Perception: New Directions in Research and Theory». In: J.L. Miller; P.D. Eimas. Handbook of Perception and Cognition: Speech, Language, and Communication. San Diego: Academic Press

- ↑ Klatt, D.H. (1976). «Linguistic uses of segmental duration in English: Acoustic and perceptual evidence». Journal of the Acoustical Society of America. 59 (5): 1208–1221. Bibcode:1976ASAJ...59.1208K. PMID 956516. doi:10.1121/1.380986

- ↑ Halle, M., Mohanan, K.P. (1985). «Segmental phonology of modern English». Linguistic Inquiry. 16 (1): 57–116

- ↑ Liberman, A.M. (1957). «Some results of research on speech perception» (PDF). Journal of the Acoustical Society of America. 29 (1): 117–123. Bibcode:1957ASAJ...29..117L. doi:10.1121/1.1908635. hdl:11858/00-001M-0000-002C-5789-A

. Consultado em 17 de maio de 2007. Cópia arquivada (PDF) em 3 de março de 2016

. Consultado em 17 de maio de 2007. Cópia arquivada (PDF) em 3 de março de 2016

- ↑ a b Fowler, C.A. (1995). «Speech production». In: J.L. Miller; P.D. Eimas. Handbook of Perception and Cognition: Speech, Language, and Communication. San Diego: Academic Press

- ↑ Hillenbrand, J.M., Clark, M.J., Nearey, T.M. (2001). «Effects of consonant environment on vowel formant patterns». Journal of the Acoustical Society of America. 109 (2): 748–763. Bibcode:2001ASAJ..109..748H. PMID 11248979. doi:10.1121/1.1337959

- ↑ Lisker, L., Abramson, A.S. (1967). «Some effects of context on voice onset time in English plosives» (PDF). Language and Speech. 10 (1): 1–28. PMID 6044530. doi:10.1177/002383096701000101. Consultado em 17 de maio de 2007. Cópia arquivada (PDF) em 3 de março de 2016

- ↑ a b Hillenbrand, J., Getty, L.A., Clark, M.J., Wheeler, K. (1995). «Acoustic characteristics of American English vowels». Journal of the Acoustical Society of America. 97 (5 Pt 1): 3099–3111. Bibcode:1995ASAJ...97.3099H. PMID 7759650. doi:10.1121/1.411872

- ↑ Houston, Derek M.; Juscyk, Peter W. (Outubro de 2000). «The role of talker-specific information in word segmentation by infants» (PDF). Journal of Experimental Psychology: Human Perception and Performance. 26 (5): 1570–1582. PMID 11039485. doi:10.1037/0096-1523.26.5.1570. Consultado em 1 de março de 2012. Cópia arquivada (PDF) em 30 de abril de 2014

- ↑ Hay, Jennifer; Drager, Katie (2010). «Stuffed toys and speech perception». Linguistics. 48 (4): 865–892. doi:10.1515/LING.2010.027

- ↑ Syrdal, A.K.; Gopal, H.S. (1986). «A perceptual model of vowel recognition based on the auditory representation of American English vowels». Journal of the Acoustical Society of America. 79 (4): 1086–1100. Bibcode:1986ASAJ...79.1086S. PMID 3700864. doi:10.1121/1.393381

- ↑ Strange, W. (1999). «Perception of vowels: Dynamic constancy». In: J.M. Pickett. The Acoustics of Speech Communication: Fundamentals, Speech Perception Theory, and Technology. Needham Heights (MA): Allyn & Bacon

- ↑ Johnson, K. (2005). «Speaker Normalization in speech perception» (PDF). In: Pisoni, D.B.; Remez, R. The Handbook of Speech Perception. Oxford: Blackwell Publishers. Consultado em 17 de maio de 2007

- ↑ Trubetzkoy, Nikolay S. (1969). Principles of phonology. Berkeley and Los Angeles: University of California Press. ISBN 978-0-520-01535-7

- ↑ Iverson, P., Kuhl, P.K. (1995). «Mapping the perceptual magnet effect for speech using signal detection theory and multidimensional scaling». Journal of the Acoustical Society of America. 97 (1): 553–562. Bibcode:1995ASAJ...97..553I. PMID 7860832. doi:10.1121/1.412280

- ↑ a b Lisker, L., Abramson, A.S. (1970). «The voicing dimension: Some experiments in comparative phonetics» (PDF). Proc. 6th International Congress of Phonetic Sciences. Prague: Academia. pp. 563–567. Consultado em 17 de maio de 2007. Cópia arquivada (PDF) em 3 de março de 2016