Análise de dados

A análise de dados é um processo de inspeção, limpeza, transformação e modelagem de dados com o objetivo de descobrir informações úteis, informar conclusões e apoiar a tomada de decisões. A análise de dados tem múltiplas facetas e abordagens, abrangendo diversas técnicas sob uma variedade de nomes, e é usada em diferentes domínios dos negócios, ciências e ciências sociais. No mundo dos negócios de hoje, a análise de dados desempenha um papel tornando a tomada de decisões mais científicas e ajudando as empresas a operar com mais eficácia.[1]

A mineração de dados é uma técnica de análise de dados específica que se concentra na modelagem estatística e na descoberta de conhecimento para fins preditivos em vez de puramente descritivos, enquanto a inteligência de negócios cobre análises de dados que dependem fortemente da agregação, com foco principalmente nas informações de negócios.[2] Em aplicativos estatísticos, a análise de dados pode ser dividida em estatística descritiva, análise exploratória de dados (AED) e análise confirmatória de dados (ACD). A AED se concentra em descobrir novas características nos dados, enquanto a ACD se concentra em confirmar ou refutar hipóteses existentes. A análise preditiva se concentra na aplicação de modelos estatísticos para previsão ou classificação preditiva, enquanto a análise de texto aplica técnicas estatísticas, linguísticas e estruturais para extrair e classificar informações de fontes textuais, um tipo de dados não estruturados. Todos os itens acima são variedades de análise de dados.

A integração de dados é um precursor da análise de dados, e a análise de dados está intimamente ligada à visualização e disseminação de dados.[3]

O processo de análise de dados[editar | editar código-fonte]

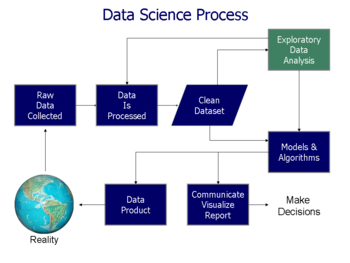

A análise refere-se à divisão de um todo em seus componentes separados para exame individual. A análise de dados é um processo de obtenção de dados brutos, e posterior conversão dos mesmos em informações úteis para a tomada de decisão dos usuários. Os dados são coletados e analisados para responder a perguntas, testar hipóteses ou refutar hipóteses.[4]

O estatístico John Tukey definiu a análise de dados em 1961, como:

"Procedimentos para a análise de dados, técnicas de interpretação dos resultados de tais procedimentos, formas de planejar a coleta de dados para tornar sua análise mais fácil, mais precisa ou mais exata, e todos os mecanismos e resultados das estatísticas (matemáticas) que se aplicam à análise de dados."[5]

Existem várias fases que podem ser distinguidas, descritas a seguir. As fases são iterativas, em que o feedback das fases posteriores pode resultar em trabalho adicional nas fases anteriores.[6] A estrutura CRISP, usada na mineração de dados, tem etapas semelhantes.

Requisitos de dados[editar | editar código-fonte]

Os dados são necessários como entradas para a análise, que é especificada com base nos requisitos daqueles que dirigem a análise ou dos clientes (que usarão o produto acabado da análise). O tipo geral de entidade sobre a qual os dados serão coletados é chamado de unidade experimental (por exemplo, uma pessoa ou população de pessoas). Variáveis específicas relacionadas a uma população (por exemplo, idade e renda) podem ser especificadas e obtidas. Os dados podem ser numéricos ou categóricos (ou seja, um rótulo de texto para números).[6]

Coleta de dados[editar | editar código-fonte]

Os dados são coletados de várias fontes. Os requisitos podem ser comunicados por analistas aos custodiantes dos dados; como o pessoal de tecnologia da informação dentro de uma organização. Os dados também podem ser coletados de sensores no ambiente, incluindo câmeras de tráfego, satélites, dispositivos de gravação, etc. Também pode ser obtido por meio de entrevistas, downloads de fontes online ou leitura de documentação.[6]

Processamento de dados[editar | editar código-fonte]

Os dados, quando obtidos inicialmente, devem ser processados ou organizados para análise. Por exemplo, isso pode envolver a colocação de dados em linhas e colunas em um formato de tabela (conhecido como dados estruturados) para análise posterior, geralmente por meio do uso de softwares estatísticos ou de planilhas.[6]

Limpeza de dados[editar | editar código-fonte]

Uma vez processados e organizados, os dados podem estar incompletos, conter duplicatas ou conter erros. A necessidade de limpeza de dados, surgirá de problemas na forma como os dados são inseridos e armazenados. A limpeza de dados é o processo de prevenção e correção desses erros. Tarefas comuns incluem correspondência de registros, identificação de dados imprecisos, qualidade geral dos dados existentes, desduplicação e segmentação de colunas.[7] Esses problemas de dados também podem ser identificados por meio de uma variedade de técnicas analíticas. Por exemplo, com informações financeiras, os totais para variáveis específicas podem ser comparados com números publicados separadamente, que se acredita serem confiáveis.[8] Valores incomuns, acima ou abaixo de limites predeterminados, também podem ser revisados. Existem vários tipos de limpeza de dados, que dependem do tipo de dados no conjunto; estes podem ser números de telefone, endereços de e-mail, empregadores ou outros valores. Os métodos de dados quantitativos para detecção de valores discrepantes podem ser usados para eliminar dados que parecem ter uma maior probabilidade de terem sido inseridos incorretamente. Os corretores ortográficos de dados textuais podem ser usados para diminuir a quantidade de palavras digitadas incorretamente, no entanto, é mais difícil dizer se as próprias palavras estão corretas.[9]

Análise exploratória de dados[editar | editar código-fonte]

Uma vez que os conjuntos de dados estejam limpos, eles podem ser analisados. Os analistas podem aplicar uma variedade de técnicas, conhecidas como análise exploratória de dados, para começar a entender as mensagens contidas nos dados obtidos. O processo de exploração de dados pode resultar em limpeza adicional dos dados ou em solicitações de dados adicionais; portanto, a inicialização das fases iterativas mencionadas no parágrafo inicial desta seção. As estatísticas descritivas, como a média ou a mediana, podem ser geradas para auxiliar na compreensão dos dados. A visualização dos dados também é uma técnica utilizada, na qual o analista pode examinar os dados em formato gráfico para obter insights adicionais sobre as mensagens contidas nos dados.[6]

Modelagem e algoritmos[editar | editar código-fonte]

Podem ser aplicadas fórmulas ou modelos matemáticos (conhecidos como algoritmos) aos dados para identificar relações entre as variáveis; por exemplo, usando correlação ou causalidade. Em termos gerais, os modelos podem ser desenvolvidos para avaliar uma variável específica com base em outras variáveis contidas no conjunto de dados, com algum erro residual dependendo da precisão do modelo implementado (por exemplo, Dados = Modelo + Erro).[4]

A estatística inferencial inclui a utilização de técnicas que medem as relações entre variáveis específicas. Por exemplo, a análise de regressão pode ser usada para modelar se uma mudança nas propagandas (variável independente X) fornece uma explicação para a variação nas vendas (variável dependente Y). Em termos matemáticos, Y (vendas) é uma função de X (publicidade). Isso pode ser descrito como (Y = aX + b + erro), onde o modelo é projetado de tal forma que (a) e (b) minimizem o erro quando o modelo prevê Y para um determinado intervalo de valores de X. Os analistas também podem tentar construir modelos descritivos dos dados, com o objetivo de simplificar a análise e comunicar os resultados.[4]

Produto de dados[editar | editar código-fonte]

Um produto de dados é um aplicativo de computador que recebe entradas de dados e gera saídas, devolvendo-os ao ambiente. Ele pode se basear em um modelo ou algoritmo. Por exemplo, um aplicativo que analisa dados sobre o histórico de compras de um cliente e usa os resultados para recomendar outras compras que o cliente possa gostar.[6]

Comunicação[editar | editar código-fonte]

Uma vez que os dados são analisados, eles podem ser apresentados em vários formatos para que os usuários da análise apoiem seus requisitos. Os usuários podem ter feedback, o que resulta em análises adicionais. Como tal, grande parte do ciclo analítico é iterativo.[6]

Ao determinar como comunicar os resultados, o analista pode considerar a implementação de uma variedade de técnicas de visualização de dados, para ajudar a comunicar a mensagem ao público de forma clara e eficiente. A visualização de dados usa telas de informações (gráficos, como tabelas e gráficos) para ajudar a comunicar as mensagens principais contidas nos dados. As tabelas são uma ferramenta valiosa, pois permitem a um usuário consultar e focar em números específicos; enquanto gráficos (por exemplo, gráficos de barras ou de linhas), podem ajudar a explicar as mensagens quantitativas contidas nos dados.

Mensagens quantitativas[editar | editar código-fonte]

Stephen Few descreveu oito tipos de mensagens quantitativas que os usuários podem tentar entender ou comunicar a partir de um conjunto de dados e os gráficos associados usados para ajudar a comunicar a mensagem. Os clientes que especificam os requisitos e os analistas que executam a análise de dados podem considerar essas mensagens no decorrer do processo.

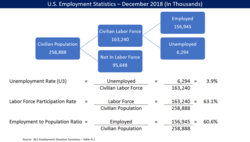

- Série temporal: uma única variável é capturada ao longo de um período de tempo, como a taxa de desemprego em um período de 10 anos. Um gráfico de linha pode ser usado para demonstrar a tendência.

- Classificação: subdivisões categóricas são classificadas em ordem crescente ou decrescente, como uma classificação de desempenho de vendas (a medida) por vendedores (a categoria, com cada vendedor uma subdivisão categórica) durante um único período. Um gráfico de barras pode ser usado para mostrar a comparação entre os vendedores.

- Parte para todo: subdivisões categóricas são medidas como uma proporção do todo (ou seja, uma porcentagem de 100%). Um gráfico de pizza ou de barras pode mostrar a comparação de proporções, como a participação de mercado representada pelos concorrentes em um mercado.

- Desvio: as subdivisões categóricas são comparadas com uma referência, como uma comparação entre despesas reais e orçadas para vários departamentos de uma empresa em um determinado período. Um gráfico de barras pode mostrar a comparação do valor real com o de referência.

- Distribuição de frequência: mostra o número de observações de uma determinada variável para determinado intervalo, como o número de anos em que o retorno do mercado de ações está entre intervalos como 0–10%, 11–20%, etc. Um histograma, um tipo de gráfico de barras, pode ser usado para esta análise.

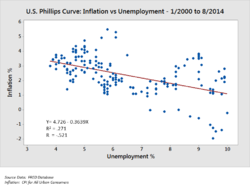

- Correlação: comparação entre observações representadas por duas variáveis (X, Y) para determinar se elas tendem a se mover na mesma direção ou em direções opostas. Por exemplo, traçando o desemprego (X) e a inflação (Y) para uma amostra de meses. Um gráfico de dispersão é normalmente usado para esta mensagem.

- Comparação nominal: comparar subdivisões categóricas sem uma ordem específica, como o volume de vendas por código de produto. Um gráfico de barras pode ser usado para esta comparação.

- Geográfico ou geoespacial: comparação de uma variável em um mapa ou layout, como a taxa de desemprego por estado ou o número de pessoas nos vários andares de um edifício. Um cartograma é um gráfico típico usado.[11][12]

Técnicas para analisar dados quantitativos[editar | editar código-fonte]

O autor Jonathan Koomey recomendou uma série de boas práticas para a compreensão de dados quantitativos. Essas incluem:

- Verificar se há anomalias nos dados brutos antes de realizar uma análise;

- Executar novamente cálculos importantes, como verificar colunas de dados resultantes de fórmulas;

- Confirme se os totais principais são a soma dos subtotais;

- Verifique as relações entre os números que devem ser relacionados de maneira previsível, como proporções ao longo do tempo;

- Normalizar números para tornar as comparações mais fáceis, como analisar valores por pessoa ou em relação ao PIB ou como um valor de índice em relação a um ano base;

- Divida os problemas em partes componentes, analisando os fatores que levaram aos resultados, como a análise DuPont do retorno sobre o patrimônio líquido.[8]

Para as variáveis em exame, os analistas normalmente obtêm estatísticas descritivas para elas, como a média, mediana e desvio padrão. Eles também podem analisar a distribuição das variáveis-chave para ver como os valores individuais se agrupam em torno da média.

Os consultores da McKinsey & Company nomearam uma técnica para decompor um problema quantitativo em suas partes componentes, chamada de princípio MECE. Cada camada pode ser dividida em suas componentes; cada uma das subcomponentes deve ser mutuamente exclusiva uma da outra e, coletivamente, ter como soma a camada acima deles. O relacionamento é conhecido como "Mutuamente Exclusivo e Coletivamente Exaustivo" ou MECE. Por exemplo, o lucro, por definição, pode ser dividido em receita total e custo total. Por sua vez, a receita total pode ser analisada por suas componentes, como a receita das divisões A, B e C (que são mutuamente exclusivas entre si) e devem ter como soma a receita total (exaustivas coletivamente).

Os analistas podem usar medições estatísticas robustas para resolver certos problemas analíticos. O teste de hipóteses é usado quando uma hipótese particular sobre o verdadeiro estado de coisas é feita pelo analista e são reunidos dados para determinar se esse estado de coisas é verdadeiro ou falso. Por exemplo, a hipótese pode ser que "O desemprego não tem efeito sobre a inflação", o que se relaciona a um conceito econômico denominado Curva de Phillips. O teste de hipóteses envolve a consideração da probabilidade de erros do tipo I e do tipo II, que se relacionam ao fato de os dados apoiarem a aceitação ou rejeição da hipótese.

A análise de regressão pode ser usada quando o analista está tentando determinar até que ponto a variável independente X afeta a variável dependente Y (por exemplo, "Até que ponto as mudanças na taxa de desemprego (X) afetam a taxa de inflação (Y)?" ) Esta é uma tentativa de modelar ou ajustar a equação de uma reta ou curva aos dados, de forma que Y seja uma função de X.

A análise de condição necessária (NCA) pode ser usada quando o analista está tentando determinar até que ponto a variável independente X permite a variável Y (por exemplo, "Até que ponto uma determinada taxa de desemprego (X) é necessária para uma determinada taxa de inflação (Y)?"). Considerando que a análise de regressão (múltipla) usa lógica aditiva onde cada variável X pode produzir o resultado e os Xs podem compensar uns aos outros (eles são suficientes, mas não necessários), a análise de condição necessária (NCA) usa lógica de necessidade, em que uma ou mais das variáveis X permitem que o resultado exista, mas podem não produzi-lo (elas são necessárias, mas não suficientes). Cada condição necessária deve estar presente e a compensação não é possível.

Atividades analíticas de usuários de dados[editar | editar código-fonte]

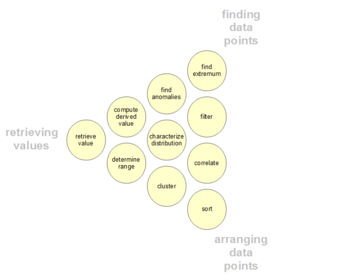

Os usuários podem ter pontos de dados específicos de interesse em um conjunto de dados, ao contrário das mensagens gerais descritas anteriormente. Essas atividades analíticas do usuário de baixo nível são apresentadas na tabela a seguir. A taxonomia também pode ser organizada por três polos de atividades: recuperação de valores, localização de pontos de dados e organização de pontos de dados.[13][14][15][16]

| # | Tarefa | Descrição Geral | Resumo padrão | Exemplos |

|---|---|---|---|---|

| 1 | Recuperar valor | Dado um conjunto de casos específicos, encontrar atributos desses casos. | Quais são os valores dos atributos {X, Y, Z, ...} nos casos de dados {A, B, C, ...}? | - Qual é a quilometragem por galão do Ford Mondeo?

- Quanto tempo dura o filme E o Vento Levou? |

| 2 | Filtrar | Dadas algumas condições concretas sobre os valores dos atributos, encontrar casos de dados que satisfaçam essas condições. | Quais casos de dados satisfazem as condições {A, B, C, ...}? | - Quais cereais Kellogg's têm alto teor de fibras?

- Quais comédias ganharam prêmios? - Quais fundos tiveram desempenho inferior ao SP-500? |

| 3 | Calcular Valor Derivado | Dado um conjunto de casos de dados, calcular uma representação numérica agregada desses casos de dados. | Qual é o valor da função de agregação F sobre um determinado conjunto S de casos de dados? | - Qual é o conteúdo calórico médio dos cereais Post?

- Qual é a receita bruta de todas as lojas combinadas? - Quantos fabricantes de automóveis existem? |

| 4 | Encontrar Extremo | Encontrar casos de dados que possuem um valor extremo de um atributo em seu intervalo no conjunto de dados. | Quais são os N casos de dados com os maiores/menores valores do atributo A? | - Qual é o carro com maior MPG?

- Qual diretor/filme ganhou mais prêmios? - Qual filme da Marvel Studios tem a data de lançamento mais recente? |

| 5 | Ordenar | Dado um conjunto de casos de dados, ordená-los de acordo com alguma métrica ordinal. | Qual é a ordem de classificação de um conjunto S de casos de dados de acordo com seus valores para o atributo A? | - Ordenar os carros por peso.

- Classificar os cereais por calorias. |

| 6 | Determinar Intervalo | Dado um conjunto de casos de dados e um atributo de interesse, encontrar o intervalo de valores dentro do conjunto. | Qual é a faixa de valores do atributo A em um conjunto S de casos de dados? | - Qual é a gama de comprimentos de filme?

- Qual é a faixa de potência do carro? - Quais atrizes estão no conjunto de dados? |

| 7 | Caracterizar distribuição | Dado um conjunto de casos de dados e um atributo quantitativo de interesse, caracterizar a distribuição dos valores desse atributo ao longo do conjunto. | Qual é a distribuição dos valores do atributo A em um conjunto S de casos de dados? | - Qual é a distribuição dos carboidratos nos cereais?

- Qual é a distribuição da idade dos compradores? |

| 8 | Encontrar Anomalias | Identificar quaisquer anomalias dentro de um determinado conjunto de casos de dados com respeito a um determinado relacionamento ou expectativa, por exemplo, outliers estatísticos. | Quais casos de dados em um conjunto S de casos de dados têm valores inesperados/excepcionais? | - Existem exceções para a relação entre potência e aceleração?

- Existem outliers na proteína? |

| 9 | Agrupar | Dado um conjunto de casos de dados, encontrar grupos de valores de atributos semelhantes. | Quais casos de dados em um conjunto S de casos de dados são semelhantes em valor para os atributos {X, Y, Z,. . . }? | - Existem grupos de cereais com gordura/calorias/açúcar semelhantes?

- Existe um grupo de durações de filme típicas? |

| 10 | Correlacionar | Dado um conjunto de casos de dados e dois atributos, determinar relações úteis entre os valores desses atributos. | Qual é a correlação entre os atributos X e Y em um determinado conjunto S de casos de dados? | - Existe correlação entre carboidratos e gordura?

- Existe correlação entre país de origem e MPG? - Os diferentes gêneros têm um método de pagamento preferido? - Existe uma tendência de aumento da duração dos filmes ao longo dos anos? |

| 11 | Contextualizar[16] | Dado um conjunto de casos de dados, encontrar a relevância contextual dos dados para os usuários. | Quais casos de dados em um conjunto S de casos de dados são relevantes para o contexto dos usuários atuais? | - Existem grupos de restaurantes que oferecem alimentos com base na minha ingestão calórica atual? |

Barreiras para uma análise eficaz[editar | editar código-fonte]

Podem existir barreiras para uma análise eficaz entre os analistas que realizam a análise de dados ou entre o público. Distinguir fato de opinião, vieses cognitivos e inumeracia são alguns dos desafios para uma análise de dados sólida.

Confusão de fato com opinião[editar | editar código-fonte]

Você pode ter sua própria opinião, mas não os seus próprios fatos.

Uma análise eficaz requer a obtenção de fatos relevantes para responder a perguntas, apoiar uma conclusão ou opinião formal ou testar hipóteses. Os fatos, por definição, são irrefutáveis, o que significa que qualquer pessoa envolvida na análise deve ser capaz de concordar com eles. Por exemplo, em agosto de 2010, o Congressional Budget Office (CBO) dos Estados Unidos estimou que estender os cortes de impostos de Bush de 2001 e 2003 para o período de 2011-2020 adicionaria aproximadamente US $ 3,3 trilhões à dívida nacional.[17] Todos devem ser capazes de concordar que realmente foi isso o que o CBO relatou; todos podem examinar o relatório. Assim, isso é um fato. Se as pessoas concordam ou discordam do CBO é sua opinião.

Como outro exemplo, o auditor de uma empresa de capital aberto deve chegar a uma opinião formal sobre se as demonstrações financeiras das empresas de capital aberto são "apresentadas de forma justa, em todos os aspectos relevantes". Isso requer uma análise extensiva de dados factuais e evidências para apoiar sua opinião. Ao passar dos fatos às opiniões, sempre existe a possibilidade de que a opinião esteja errada.

Vieses cognitivos[editar | editar código-fonte]

Existem vários vieses cognitivos que podem afetar negativamente a análise. Por exemplo, o viés de confirmação é a tendência de alguém buscar ou interpretar informações de uma forma que confirme os seus preconceitos. Além disso, os indivíduos podem desacreditar informações que não apoiem seus pontos de vista.

Os analistas podem ser treinados especificamente para estar cientes desses vieses e como superá-los. Em seu livro Psychology of Intelligence Analysis, o analista aposentado da CIA Richards Heuer escreveu que os analistas devem delinear claramente suas suposições e cadeias de inferência e especificar o grau e a fonte da incerteza envolvida nas conclusões. Ele enfatizou procedimentos para ajudar a expor e debater pontos de vista alternativos.[18]

Inumeracia[editar | editar código-fonte]

Os analistas eficazes geralmente são adeptos de uma variedade de técnicas numéricas. No entanto, o público pode não ter tal proficiência com números ou numeracia; eles são considerados inumerados. As pessoas que comunicam os dados também podem tentar enganar ou desinformar, usando deliberadamente técnicas numéricas inadequadas.[19]

Por exemplo, o aumento ou diminuição de um número pode não ser o fator principal. Pode ser mais importante o número relativo a outro número, como o tamanho da receita ou gasto do governo em relação ao tamanho da economia (PIB) ou o valor do custo em relação à receita nas demonstrações financeiras corporativas. Essa técnica numérica é conhecida como normalização[8] ou dimensionamento comum. Existem muitas dessas técnicas empregadas por analistas, seja ajustando pela inflação (ou seja, comparando dados reais com nominais) ou considerando aumentos populacionais, demografia, etc. Os analistas aplicam uma variedade de técnicas para lidar com as várias mensagens quantitativas descritas na seção anterior.

Os analistas também podem analisar dados sob diferentes hipóteses ou cenários. Por exemplo, quando os analistas realizam análises de demonstrações financeiras, eles frequentemente reformulam as demonstrações financeiras sob diferentes suposições para ajudar a chegar a uma estimativa do fluxo de caixa futuro, que eles então descontam ao valor presente com base em alguma taxa de juros, para determinar a avaliação da empresa ou de suas ações. Da mesma forma, o CBO analisa os efeitos de várias opções de política sobre as receitas, despesas e déficits do governo dos EUA, criando cenários futuros alternativos para medidas-chave.

Outros tópicos[editar | editar código-fonte]

Edifícios inteligentes[editar | editar código-fonte]

Uma abordagem de análise de dados pode ser usada para prever o consumo de energia em edifícios.[20] As diferentes etapas do processo de análise de dados são realizadas a fim de obter edifícios inteligentes, nos quais as operações de gerenciamento e controle do edifício, incluindo aquecimento, ventilação, ar condicionado, iluminação e segurança, são realizadas automaticamente, imitando as necessidades dos usuários do edifício e otimizando recursos como energia e tempo.

Analytics e inteligência de negócios[editar | editar código-fonte]

Analytics é o "uso extensivo de dados, análises estatísticas e quantitativas, modelos explicativos e preditivos e gerenciamento baseado em fatos para conduzir decisões e ações". É um subconjunto de inteligência de negócios, que é um conjunto de tecnologias e processos que usam dados para entender e analisar o desempenho dos negócios.[21]

Educação[editar | editar código-fonte]

Na educação, a maioria dos educadores tem acesso a um sistema de dados com o objetivo de analisar os dados de alunos.[22] Esses sistemas de dados apresentam dados aos educadores em um formato de dados over-the-counter (incorporando rótulos, documentação suplementar e um sistema de ajuda e tomando decisões chave de pacote/exibição e conteúdo) para melhorar a precisão das análises de dados dos educadores.[23]

Notas dos profissionais[editar | editar código-fonte]

Esta seção contém explicações bastante técnicas que podem ajudar os profissionais, mas estão além do escopo típico de um artigo da Wikipédia.

Análise inicial dos dados[editar | editar código-fonte]

A distinção mais importante entre a fase inicial da análise de dados e a fase principal da análise é que, durante a análise inicial dos dados, a pessoa se abstém de qualquer análise que tenha como objetivo responder à questão original da pesquisa. A fase inicial de análise de dados é guiada pelas seguintes quatro questões:[24]

Qualidade de dados[editar | editar código-fonte]

A qualidade dos dados deve ser verificada o mais cedo possível. A qualidade dos dados pode ser avaliada de várias maneiras, usando diferentes tipos de análise: contagens de frequência, estatísticas descritivas (média, desvio padrão, mediana), normalidade (assimetria, curtose, histogramas de frequência), imputação normal é necessária:

- Análise de observações extremas: observações discrepantes nos dados são analisadas para ver se parecem perturbar a distribuição.

- Comparação e correção de diferenças em esquemas de codificação: as variáveis são comparadas com esquemas de codificação de variáveis externos ao conjunto de dados e possivelmente corrigidas se os esquemas de codificação não forem comparáveis.

- Teste a variância do método comum.

A escolha das análises para avaliar a qualidade dos dados durante a fase inicial de análise de dados depende das análises que serão conduzidas na fase de análise principal.[25]

Qualidade das medições[editar | editar código-fonte]

A qualidade dos instrumentos de medição só deve ser verificada durante a fase inicial de análise dos dados, quando este não for o foco ou questão de pesquisa do estudo. Deve-se verificar se a estrutura dos instrumentos de medição corresponde à estrutura relatada na literatura.

Existem duas maneiras de avaliar a medição:

- Análise de fatores confirmatórios

- Análise de homogeneidade (consistência interna), que dá uma indicação da confiabilidade de um instrumento de medição. Durante esta análise, são inspecionadas as variâncias dos itens e das escalas, o α de Cronbach das escalas e a mudança no alfa de Cronbach caso um item fosse excluído de uma escala[26]

Transformações iniciais[editar | editar código-fonte]

Depois de avaliar a qualidade dos dados e das medições, pode-se decidir imputar dados faltantes ou realizar transformações iniciais de uma ou mais variáveis, embora isso também possa ser feito durante a fase principal de análise.[27]As possíveis transformações de variáveis são:[28]

- Transformação de raiz quadrada (se a distribuição difere moderadamente de uma normal)

- Transformação de log (se a distribuição for substancialmente diferente de uma normal)

- Transformação inversa (se a distribuição for muito diferente de uma normal)

- Transformação em categórica (ordinal/dicotômico) (se a distribuição for muito diferente de uma normal e nenhuma transformação ajudar)

A implementação do estudo atendeu às intenções do projeto de pesquisa?[editar | editar código-fonte]

Deve-se verificar o sucesso do procedimento de aleatorização, por exemplo, verificando se as variáveis de fundo e substantivas estão igualmente distribuídas dentro e entre os grupos.Caso o estudo não necessite ou utilize procedimento de aleatorização, deve-se verificar o sucesso da amostragem não aleatória, por exemplo, verificando se todos os subgrupos da população de interesse estão representados na amostra.Outras possíveis distorções de dados que devem ser verificadas são:

- Abandono (isso deve ser identificado durante a fase inicial de análise de dados)

- A não resposta ao item (seja aleatório ou não, deve ser avaliada durante a fase inicial de análise de dados)

- Qualidade do tratamento (usando verificações de manipulação).[29]

Características da amostra de dados[editar | editar código-fonte]

Em qualquer relatório ou artigo, a estrutura da amostra deve ser descrita de maneira precisa. É especialmente importante determinar exatamente a estrutura da amostra (e especificamente o tamanho dos subgrupos) quando se pretende fazer análises de subgrupo durante a fase de análise principal.As características da amostra de dados podem ser avaliadas observando:

- Estatísticas básicas de variáveis importantes

- Gráficos de dispersão

- Correlações e associações

- Tabulações cruzadas[30]

Fase final da análise inicial dos dados[editar | editar código-fonte]

Durante o estágio final, os resultados da análise de dados inicial são documentados e são tomadas as ações corretivas necessárias, preferíveis e possíveis são tomadas.

Além disso, o plano original para as análises de dados principais pode e deve ser especificado com mais detalhes ou reescrito.

Para fazer isso, várias decisões sobre as análises de dados principais podem e devem ser feitas:

- No caso de não normais: deve-se transformar as variáveis; tornar as variáveis categóricas (ordinais/dicotômicas); adaptar o método de análise?

- No caso de dados faltantes: deve-se negligenciar ou imputar os dados faltantes; qual técnica de imputação deve ser usada?

- No caso de outliers: deve-se usar técnicas de análise robustas?

- Caso os itens não se enquadrem na escala: deve-se adaptar o instrumento de medição omitindo itens, ou antes garantir a comparabilidade com outros (usos do(s)) instrumento(s) de medição?

- No caso de subgrupos (muito) pequenos: deve-se abandonar a hipótese sobre diferenças entre os grupos ou usar técnicas de pequenas amostras, como testes exatos ou bootstrapping?

- Caso o procedimento de randomização pareça defeituoso: pode-se e deve-se calcular os escores de propensão e incluí-los como covariáveis nas análises principais?[31]

Análise[editar | editar código-fonte]

Várias análises podem ser usadas durante a fase inicial de análise de dados:[32]

- Estatísticas univariadas (variável única)

- Associações bivariadas (correlações)

- Técnicas gráficas (gráficos de dispersão)

É importante levar em consideração os níveis de medição das variáveis para as análises, pois técnicas estatísticas especiais estão disponíveis para cada nível:[33]

- Variáveis nominais e ordinais

- Contagens de frequência (números e porcentagens)

- Associações

- circumambulações (tabulações cruzadas)

- análise loglinear hierárquica (restrita a um máximo de 8 variáveis)

- análise loglinear (para identificar variáveis relevantes/importantes e possíveis fatores de confusão)

- Testes exatos ou reamostragem (no caso de os subgrupos serem pequenos)

- Cálculo de novas variáveis

- Variáveis contínuas

- Distribuição

- Estatísticas (M, SD, variância, assimetria, curtose)

- Expositores de caule e folha

- Boxplots

- Distribuição

Análise não linear[editar | editar código-fonte]

A análise não linear é frequentemente necessária quando os dados são registrados a partir de um sistema não linear. Os sistemas não lineares podem exibir efeitos dinâmicos complexos, incluindo bifurcações, caos, harmônicos e subarmônicos que não podem ser analisados usando métodos lineares simples. A análise de dados não lineares está intimamente relacionada à identificação do sistema não linear.[34]

Análise de dados principal[editar | editar código-fonte]

Na fase principal de análise, são realizadas análises destinadas a responder à questão de pesquisa, bem como qualquer outra análise relevante que seja necessária para escrever o primeiro rascunho do relatório de pesquisa.[35]

Abordagens exploratórias e confirmatórias[editar | editar código-fonte]

Na fase de análise principal, pode ser adotada uma abordagem exploratória ou confirmatória. Normalmente, a abordagem é decidida antes de os dados serem coletados. Em uma análise exploratória, nenhuma hipótese clara é declarada antes de analisar os dados, e os dados são pesquisados em busca de modelos que os descrevam bem. Em uma análise confirmatória, são testadas hipóteses claras sobre os dados.

A análise exploratória de dados deve ser interpretada com cuidado. Ao testar vários modelos ao mesmo tempo, há uma grande chance de descobrir que pelo menos um deles é significativo, mas isso pode ser devido a um erro do tipo 1. É importante sempre ajustar o nível de significância ao testar vários modelos com, por exemplo, uma correção de Bonferroni. Além disso, não se deve seguir uma análise exploratória com uma análise confirmatória no mesmo conjunto de dados. Uma análise exploratória é usada para encontrar ideias para uma teoria, mas não para testar essa teoria também. Quando um modelo é encontrado durante a análise exploratória em um conjunto de dados, a continuação dessa análise com uma análise confirmatória no mesmo conjunto de dados pode simplesmente significar que os resultados da análise confirmatória se devem ao mesmo erro do tipo 1 que inicialmente resultou no modelo exploratório. A análise confirmatória, portanto, não será mais informativa do que a análise exploratória original.[36]

Estabilidade dos resultados[editar | editar código-fonte]

É importante obter alguma indicação sobre o quão generalizáveis são os resultados.[37] Embora muitas vezes seja difícil de verificar, pode-se olhar para a estabilidade dos resultados. Os resultados são confiáveis e reproduzíveis? Existem duas maneiras principais de fazer isso.

- Validação cruzada. Ao dividir os dados em várias partes, podemos verificar se uma análise (como um modelo ajustado) com base em uma parte dos dados também se generaliza para outra parte dos dados. A validação cruzada é geralmente inadequada, no entanto, se houver correlações nos dados, por exemplo, com dados em painel. Portanto, às vezes é necessário usar outros métodos de validação. Para mais informações sobre este tópico, consulte sobre validação de modelo estatístico.

- Análise de sensibilidade. Um procedimento para estudar o comportamento de um sistema ou modelo quando os parâmetros globais são variados (sistematicamente). Uma maneira de fazer isso é por meio de bootstrap.

Software livre para análise de dados[editar | editar código-fonte]

Entre os softwares livres notáveis para análise de dados estão:

- DevInfo – Um sistema de banco de dados endossado pelo Grupo das Nações Unidas para o Desenvolvimento para monitorar e analisar o desenvolvimento humano.

- ELKI – Um framework de mineração de dados em Java com funções de visualização orientadas para a mineração de dados.

- KNIME – The Konstanz Information Miner, uma estrutura de análise de dados abrangente e amigável.

- Orange – Uma ferramenta de programação visual com visualização de dados interativa e métodos para análise estatística de dados, mineração de dados e aprendizado de máquina.

- Pandas – biblioteca para a análise de dados em Python.

- PAW – Estrutura de análise de dados em FORTRAN/C desenvolvida no CERN.

- R – Uma linguagem de programação e ambiente de software para computação estatística e gráficos.

- ROOT – framework de análise de dados em C++ desenvolvido no CERN .

- SciPy – biblioteca para a análise de dados em Python.

- Dados. Análise – uma biblioteca .NET para análise e transformação de dados.

- Julia – uma linguagem de programação adequada para análise numérica e ciência computacional.

- Taguette - análise de dados qualitativos.

Concursos internacionais de análise de dados[editar | editar código-fonte]

Diferentes empresas ou organizações realizam concursos de análise de dados para incentivar os pesquisadores a utilizar seus dados ou para resolver uma questão específica usando a análise de dados. Alguns exemplos de concursos internacionais de análise de dados conhecidos são os seguintes:

- Competição Kaggle realizada por Kaggle[38]

- Concurso de análise de dados LTPP realizado pela FHWA e ASCE.[39][40]

Ver também[editar | editar código-fonte]

- Ciência atuarial

- Analítica

- Big data

- Business intelligence

- Censura (estatística)

- Física computacional

- Aquisição de dados

- Data blending

- Governança de dados

- Mineração de dados

- Visualização de dados

- Ciência de dados

- Processamento de sinais digitais

- Redução de dimensionalidade

- Análise de casos iniciais

- Análise exploratória de dados

- Análise de Fourier

- Aprendizagem de máquina

- PCA multilinear[1]

- Aprendizado de subespaços multilinear

- Análise de dados multiway

- Pesquisa de vizinho mais próximo

- Identificação de sistema não linear

- Análise preditiva

- Análise de componentes principais

- Pesquisa qualitativa

- Computação científica

- Identificação de sistemas

- Método de teste

- Mineração de texto

- Wavelet

Referências[editar | editar código-fonte]

Citações[editar | editar código-fonte]

- ↑ Xia, B. S., & Gong, P. (2015). Review of business intelligence through data analysis. Benchmarking, 21(2), 300-311. doi:10.1108/BIJ-08-2012-0050

- ↑ Exploring Data Analysis

- ↑ Sherman, Rick (4 de novembro de 2014). Business intelligence guidebook : from data integration to analytics. Amsterdam: [s.n.] ISBN 978-0-12-411528-6. OCLC 894555128

- ↑ a b c Judd, Charles and, McCleland, Gary (1989). Data Analysis. [S.l.]: Harcourt Brace Jovanovich. ISBN 0-15-516765-0

- ↑ John Tukey-The Future of Data Analysis-July 1961

- ↑ a b c d e f g Schutt, Rachel; O'Neil, Cathy (2013). Doing Data Science. [S.l.]: O'Reilly Media. ISBN 978-1-449-35865-5

- ↑ «Data Cleaning». Microsoft Research. Consultado em 26 de outubro de 2013

- ↑ a b c Perceptual Edge-Jonathan Koomey-Best practices for understanding quantitative data-February 14, 2006

- ↑ Hellerstein, Joseph (27 de fevereiro de 2008). «Quantitative Data Cleaning for Large Databases» (PDF). EECS Computer Science Division: 3. Consultado em 26 de outubro de 2013

- ↑ Grandjean, Martin (2014). «La connaissance est un réseau» (PDF). Les Cahiers du Numérique. 10: 37–54. doi:10.3166/lcn.10.3.37-54

- ↑ Stephen Few-Perceptual Edge-Selecting the Right Graph for Your Message-2004

- ↑ Stephen Few-Perceptual Edge-Graph Selection Matrix

- ↑ Robert Amar, James Eagan, and John Stasko (2005) "Low-Level Components of Analytic Activity in Information Visualization"

- ↑ William Newman (1994) "A Preliminary Analysis of the Products of HCI Research, Using Pro Forma Abstracts"

- ↑ Mary Shaw (2002) "What Makes Good Research in Software Engineering?"

- ↑ a b «ConTaaS: An Approach to Internet-Scale Contextualisation for Developing Efficient Internet of Things Applications». ScholarSpace. HICSS50. Consultado em 24 de maio de 2017

- ↑ «Congressional Budget Office-The Budget and Economic Outlook-August 2010-Table 1.7 on Page 24». Consultado em 31 de março de 2011

- ↑ «Introduction». cia.gov

- ↑ Bloomberg-Barry Ritholz-Bad Math that Passes for Insight-October 28, 2014

- ↑ González-Vidal, Aurora; Moreno-Cano, Victoria (2016). «Towards energy efficiency smart buildings models based on intelligent data analytics». Procedia Computer Science. 83: 994–999. doi:10.1016/j.procs.2016.04.213

- ↑ Davenport, Thomas and, Harris, Jeanne (2007). Competing on Analytics. [S.l.]: O'Reilly. ISBN 978-1-4221-0332-6

- ↑ Aarons, D. (2009). Report finds states on course to build pupil-data systems. Education Week, 29(13), 6.

- ↑ Rankin, J. (2013, March 28). How data Systems & reports can either fight or propagate the data analysis error epidemic, and how educator leaders can help. Presentation conducted from Technology Information Center for Administrative Leadership (TICAL) School Leadership Summit.

- ↑ Adèr 2008a, p. 337.

- ↑ Adèr 2008a, pp. 338-341.

- ↑ Adèr 2008a, pp. 341-342.

- ↑ Adèr 2008a, p. 344.

- ↑ Tabachnick & Fidell, 2007, p. 87-88.

- ↑ Adèr 2008a, pp. 344-345.

- ↑ Adèr 2008a, p. 345.

- ↑ Adèr 2008a, pp. 345-346.

- ↑ Adèr 2008a, pp. 346-347.

- ↑ Adèr 2008a, pp. 349-353.

- ↑ Billings S.A. "Nonlinear System Identification: NARMAX Methods in the Time, Frequency, and Spatio-Temporal Domains". Wiley, 2013

- ↑ Adèr 2008b, p. 363.

- ↑ Adèr 2008b, pp. 361-362.

- ↑ Adèr 2008b, pp. 361-371.

- ↑ «The machine learning community takes on the Higgs». Symmetry Magazine. 15 de julho de 2014. Consultado em 14 de janeiro de 2015

- ↑ Nehme, Jean (29 de setembro de 2016). «LTPP International Data Analysis Contest». Federal Highway Administration. Consultado em 22 de outubro de 2017

- ↑ «Data.Gov:Long-Term Pavement Performance (LTPP)». 26 de maio de 2016. Consultado em 10 de novembro de 2017

Bibliografia[editar | editar código-fonte]

- Adèr, Herman J. (2008a). «Chapter 14: Phases and initial steps in data analysis». In: Adèr; Mellenbergh; Hand. Advising on research methods : a consultant's companion. Huizen, Netherlands: Johannes van Kessel Pub. pp. 333–356. ISBN 9789079418015. OCLC 905799857

- Adèr, Herman J. (2008b). «Chapter 15: The main analysis phase». In: Adèr; Mellenbergh; Hand. Advising on research methods : a consultant's companion. Huizen, Netherlands: Johannes van Kessel Pub. pp. 357–386. ISBN 9789079418015. OCLC 905799857

- Tabachnick, BG & Fidell, LS (2007). Capítulo 4: Limpando seu ato. Dados de triagem antes da análise. Em BG Tabachnick & LS Fidell (Eds. ), Usando Estatísticas Multivariadas, Quinta Edição (pp. 60–116). Boston: Pearson Education, Inc. / Allyn e Bacon.

Leitura complementar[editar | editar código-fonte]

- Adèr, HJ & Mellenbergh, GJ (com contribuições de DJ Hand) (2008). Aconselhamento sobre métodos de pesquisa: um companheiro do consultor . Huizen, Holanda: Johannes van Kessel Publishing.

- Chambers, John M .; Cleveland, William S .; Kleiner, Beat; Tukey, Paul A. (1983). Graphical Methods for Data Analysis, Wadsworth / Duxbury Press. ISBN 0-534-98052-X

- Fandango, Armando (2008). Análise de dados Python, 2ª edição . Packt Publishers.

- Juran, Joseph M .; Godfrey, A. Blanton (1999). Manual de qualidade de Juran, 5ª edição. Nova York: McGraw Hill. ISBN 0-07-034003-X

- Lewis-Beck, Michael S. (1995). Análise de dados: uma introdução, Sage Publications Inc,ISBN 0-8039-5772-6

- NIST / SEMATECH (2008) Manual de Métodos Estatísticos ,

- Pyzdek, T, (2003). Manual de Engenharia de Qualidade, ISBN 0-8247-4614-7

- Richard Veryard (1984). Análise de dados pragmática . Oxford : Publicações científicas da Blackwell. ISBN 0-632-01311-7

- Tabachnick, BG; Fidell, LS (2007). Usando Estatísticas Multivariadas, 5ª Edição . Boston: Pearson Education, Inc. / Allyn e Bacon, ISBN 978-0-205-45938-4