Coeficiente de correlação de postos de Spearman: diferenças entre revisões

-{{sem fontes}}... ao consultar a fonte apontada pelo IP da última edição, verifiquei que referencia apenas a fórmula... |

Inserção de conteúdo traduzido do verbete em inglês. Adaptação de conteúdo em português. |

||

| Linha 1: | Linha 1: | ||

{{Estatística sidebar}} |

|||

[[File:Spearman 500x325.png|thumb|O coeficiente de correlação de Spearman é menos sensível do que o de Pearson a valores muito distantes do esperado. Neste exemplo: Pearson = 0.30706 Spearman = 0.76270]] |

|||

Em [[estatística]], o '''coeficiente de correlação de postos de Spearman''' ou '''rô de Spearman''', que recebe este nome em homenagem ao psicólogo e estatístico [[Charles Spearman]], frequentemente denotado pela letra grega <math>\rho</math> (rô) ou <math>r_s</math>, é uma medida [[Estatística não paramétrica|não paramétrica]] de correlação de postos (dependência estatística entre a [[Ranking|classificação]] de duas [[Variável (matemática)|variáveis]]). O coeficiente avalia com que intensidade a relação entre duas variáveis pode ser descrita pelo uso de uma [[função monótona]].<ref>{{Citar periódico|ultimo=Spearman|primeiro=C.|data=1904|titulo=The Proof and Measurement of Association between Two Things|jornal=The American Journal of Psychology|volume=15|numero=1|paginas=72–101|doi=10.2307/1412159|url=http://www.jstor.org/stable/1412159}}</ref> A '''correlação de Spearman''' entre duas variáveis é igual à [[Coeficiente de correlação de Pearson|correlação de Pearson]] entre os valores de postos daquelas duas variáveis. Enquanto a correlação de Pearson avalia relações lineares, a correlação de Spearman avalia relações monótonas, sejam elas lineares ou não.<ref>{{Citar livro|url=https://books.google.com.br/books?id=ly4nAQAAIAAJ&q=Kendall+Rank+correlation+methods&dq=Kendall+Rank+correlation+methods&hl=pt-BR&sa=X&redir_esc=y|título=Rank correlation methods|ultimo=Kendall|primeiro=Maurice George|ultimo2=Gibbons|primeiro2=Jean Dickinson|data=1990|editora=E. Arnold|lingua=en}}</ref> Se não houver valores de dados repetidos, uma correlação de Spearman perfeita de +1 ou -1 ocorre quando cada uma das variáveis é uma função monótona perfeita da outra. |

|||

Na [[estatística]], o '''coeficiente de correlação de postos de Spearman''', chamado assim devido a [[Charles Spearman]] e normalmente denominado pela letra grega [[ρ]] (rho), é uma medida de [[correlação]] [[não-paramétrica]], isto é, ele avalia uma [[função monótona]] arbitrária que pode ser a descrição da relação entre duas [[variáveis]], sem fazer nenhumas suposições sobre a [[distribuição de frequências]] das variáveis. |

|||

Intuitivamente, a correlação de Spearman entre duas variáveis será alta quando observações tiverem uma classificação semelhante (ou idêntica no caso da correlação igual a 1) entre as duas variáveis, isto é, a posição relativa das observações no interior da variável (1º, 2º, 3º, etc.), e baixa quando observações tiverem uma classificação dessemelhante (ou completamente oposta no caso da correlação igual a -1) entre as duas variáveis. |

|||

Ao contrário do [[coeficiente de correlação de Pearson]], não requer a suposição que a relação entre as variáveis é [[linear]], nem requer que as variáveis sejam medidas em [[intervalo de classe]]; pode ser usado para as variáveis medidas no nível ordinal.<ref>{{citar web|url=http://www.statstutor.ac.uk/resources/uploaded/spearmans.pdf|título=Spearman's correlation|publicado=statstutor|acessadoem=26 de junho de 2017}}</ref> |

|||

O coeficiente de Spearman é apropriado tanto para variáveis contínuas, como para variáveis discretas, incluindo variáveis [[Escala (estatística)|ordinais]].<ref>{{Citar livro|url=https://books.google.com.br/books?id=Zh4iD8V2sTsC&printsec=frontcover&dq=Jmp+For+Basic+Univariate+And+Multivariate+Statistics&hl=pt-BR&sa=X&redir_esc=y#v=onepage&q=Jmp%20For%20Basic%20Univariate%20And%20Multivariate%20Statistics&f=false|título=JMP for Basic Univariate and Multivariate Statistics: Methods for Researchers and Social Scientists, Second Edition|ultimo=Lehman|primeiro=Ann|ultimo2=O'Rourke|primeiro2=Norm|ultimo3=Hatcher|primeiro3=Larry|ultimo4=Stepanski|primeiro4=Edward|data=2013|editora=SAS Institute|lingua=en|isbn=9781612906034}}</ref> Tanto o <math>\rho</math> de Spearman, como o [[Coeficiente de correlação tau de Kendall|<math>\tau</math> de Kendall]] pode ser formulados como casos especiais de um coeficiente de correlação mais geral. |

|||

Se não houver nenhum posto estabelecido, isto é.<math>\neg\exists_{i,j} i\ne j \wedge (x_i=x_j \vee y_i=y_j)</math> |

|||

==Definição e cálculo== |

|||

o ρ é dado por: |

|||

[[File:spearman fig1.svg|300px|thumb|Uma correlação de Spearman igual a 1 ocorre quando as duas variáveis comparadas são monotonamente relacionadas, mesmo se a relação entre elas não for linear. Isto quer dizer que todos os pontos de dados com valores <math>x</math> maiores do que o valor de um ponto de dado específico terão valores <math>y</math> maiores também. Em contraste, isto não dá uma correlação de Pearson perfeita.]] |

|||

O coeficiente de correlação de Spearman é definido como o coeficiente de correlação de Pearson entre variáveis classificadas em postos.<ref>{{Citar livro|url=https://books.google.com.br/books?id=7ep8FjCcloYC&printsec=frontcover&dq=research+Design+and+Statistical+Analysis&hl=pt-BR&sa=X&ved=0ahUKEwjw-e_ElpbVAhWGF5AKHUBlA1oQ6AEIKjAA#v=onepage&q=research%20Design%20and%20Statistical%20Analysis&f=false|título=Research Design and Statistical Analysis: Third Edition|ultimo=Myers|primeiro=Jerome L.|ultimo2=Well|primeiro2=Arnold D.|ultimo3=Jr|primeiro3=Robert F. Lorch|data=2013-01-11|editora=Routledge|lingua=en|isbn=9781135811631}}</ref> |

|||

Para uma amostra de tamanho <math>n</math>, os <math>n</math> dados brutos <math>X_i,Y_i</math> são convertidos em postos <math>\operatorname{rg}X_i,\operatorname{rg}Y_i</math> e <math>r_s</math> é computado a partir de: |

|||

:<math> \rho = 1- {\frac {6 \sum d_i^2}{(n^3-n)}}</math> |

|||

:<math>r_s=\rho_{\operatorname{rg}_X,\operatorname{rg}_Y}=\frac{\operatorname{cov}(\operatorname{rg}_X,\operatorname{rg}_Y)}{\sigma_{\operatorname{rg}_X}\sigma_{\operatorname{rg}_Y}},</math> |

|||

ou ainda: |

|||

:em que |

|||

:*<math>\rho</math> denota o usual coeficiente de correlação de Pearson, mas aplicado às variáveis em postos; |

|||

:*<math>\operatorname{cov}(\operatorname{rg}_X, \operatorname{rg}_Y)</math> é a [[covariância]] das variáveis em postos; |

|||

:*<math>\sigma_{\operatorname{rg}_X}</math> e <math>\sigma_{\operatorname{rg}_Y}</math> são os [[Desvio padrão|desvios padrão]] das variáveis em postos.<ref>{{Citar livro|url=https://books.google.com.br/books?id=bCDFAAAACAAJ&dq=Applied+Nonparametric+Statistics&hl=pt-BR&sa=X&redir_esc=y|título=Applied Nonparametric Statistics|ultimo=Daniel|primeiro=Wayne W.|data=2000-06-30|editora=Duxbury|lingua=en|isbn=9780534381943}}</ref> |

|||

Apenas se todos os postos <math>n</math> forem números inteiros distintos, o coeficiente pode ser calculado usando a fórmula popular: |

|||

:<math> \rho = 1- {\frac {6 \sum d_i^2}{n(n^2-1)}}</math> |

|||

:<math> r_s={1-\frac{6\sum d_i^2}{n(n^2-1)}},</math> |

|||

Onde: |

|||

:em que |

|||

:*<math>d_i=\operatorname{rg}(X_i)-\operatorname{rg}(Y_i)</math> é a diferença entre os dois postos de cada observação; |

|||

:*<math>n</math> é o número de observações.<ref>{{Citar livro|url=https://books.google.com.br/books?id=Y5s3AgAAQBAJ&printsec=frontcover&dq=Nonparametric+statistical+methods&hl=pt-BR&sa=X&redir_esc=y#v=onepage&q=Nonparametric%20statistical%20methods&f=false|título=Nonparametric Statistical Methods|ultimo=Hollander|primeiro=Myles|ultimo2=Wolfe|primeiro2=Douglas A.|ultimo3=Chicken|primeiro3=Eric|data=2013-11-25|editora=John Wiley & Sons|lingua=en|isbn=9781118553299}}</ref><ref>{{Citar livro|url=https://books.google.com.br/books?id=PSzkngEACAAJ&dq=spiegel+Estat%C3%ADstica+1985&hl=pt-BR&sa=X&redir_esc=y|título=Estatistica; resumo da teoria 875 problemas resolvidos 619 problemas propostos|ultimo=Spiegel|primeiro=M. R.|data=1985|editora=Fundacao CARGILL|lingua=pt}}</ref> |

|||

Quando há valores idênticos, geralmente se atribui a cada valor um posto fracionário igual à média de suas posições na ordem ascendente dos valores, que é equivalente ao cálculo da média de todas as permutações possíveis.<ref>{{Citar livro|url=https://books.google.com.br/books?id=k2zklGOBRDwC&printsec=frontcover&dq=The+Concise+Encyclopedia+of+Statistics&hl=pt-BR&sa=X&ved=0ahUKEwjaiIT4mJbVAhVBIZAKHYRQBA8Q6AEIJzAA#v=onepage&q=The%20Concise%20Encyclopedia%20of%20Statistics&f=false|título=The Concise Encyclopedia of Statistics|ultimo=Dodge|primeiro=Yadolah|data=2008-04-15|editora=Springer Science & Business Media|lingua=en|isbn=9780387317427}}</ref> |

|||

:''<math>d_i</math>'' = a diferença entre cada posto de valor correspondentes de x e y, e |

|||

Se valores repetidos estiverem presentes nos conjuntos de dados, a equação produz resultados incorretos. Apenas se, em ambas as variáveis, todos os postos forem distintos, então, <math>\sigma_{\operatorname{rg}_X}\sigma_{\operatorname{rg}_Y}=\operatorname{Var}{\operatorname{rg}_X}=\operatorname{Var}{\operatorname{rg}_Y}=n(n^2-1)/6</math> (vide [[número tetraédrico]] <math>T_{n-1}</math>). A primeira equação — normalizando pelo desvio padrão — pode ser usada até mesmo quando os postos forem normalizados a <math>[0;1]</math> ("postos relativos"), porque não é sensível tanto à translação, quanto ao escalonamento linear. |

|||

:''<math>n</math>'' = o número dos pares dos valores.<ref>SPIEGEL, M. R. "Estatística". São Paulo: McGraw-Hill do Brasil, 1985.</ref> |

|||

Este método também não deve ser usado em casos em que o conjunto de dados estiver truncado, isto é, quando o coeficiente de correlação de Spearman for desejado para os <math>X</math> registros do topo (seja pelos postos pré-mudança, pelos postos pós-mudança ou ambos). Neste caso, deve-se usar a fórmula do coeficiente de correlação de Pearson descrita acima. |

|||

Para amostras maiores que 20 observações, podemos utilizar a seguinte aproximação para a [[distribuição t de Student]] |

|||

O erro padrão <math>\sigma</math> do coeficiente foi determinado pelo estatístico britânico [[Karl Pearson]] em 1907 e pelo matemático britânico Thorold Gosset em 1920, sendo: |

|||

:<math>t = \frac{\rho}{\sqrt{(1-\rho^2)/(n-2)}}</math> |

|||

:<math>\sigma_{r_s}=\frac{0.6325}{\sqrt{n-1}}.</math> |

|||

==Exemplo== |

|||

Neste exemplo, usaremos os dados brutos da tabela abaixo para calcular a correlação entre o [[QI]] de uma pessoa com o número de horas de [[televisão]] assistidas por semana. |

|||

==Quantidades relacionadas== |

|||

{| class="wikitable" |

|||

{| style="float: right;" |

|||

|+ '''Correlações de postos de Spearman positiva e negativa''' |

|||

|- |

|||

| [[File:spearman fig5.svg|300px|left|thumb|Um coeficiente de correlação de Spearman positivo corresponde a uma tendência monotônica crescente entre <math>X</math> e <math>Y</math>.]] |

|||

| [[File:spearman fig4.svg|300px|thumb|Um coeficiente de correlação de Spearman negativo corresponde a uma tendência monotônica decrescente entre <math>X</math> e <math>Y</math>.]] |

|||

|} |

|||

{{artigo principal|Correlação}}Há várias outras medidas numéricas que quantificam a intensidade da dependência estatística entre parers de observações. A mais comum é o coeficiente de correlação produto-momento de Pearson, que é um método de correlação semelhante ao coeficiente de correlação de postos de Spearman, que mede as relações "lineares" entre números brutos, não entre seus postos. |

|||

Um nome alternativo para a correlação de postos de Spearman é "correlação de grau".<ref>{{Citar livro|url=https://books.google.com.br/books?id=TiA5YAAACAAJ&dq=Yule+Kendall+An+Introduction+to+the+Theory+of+Statistics&hl=pt-BR&sa=X&ved=0ahUKEwitkqHyoZbVAhVEhpAKHSWVBtEQ6AEIKjAB|título=An Introduction to the Theory of Statistics. G. Udny Yule, ... and M.G. Kendall, ... 14th Edition Revised and Enlarged|ultimo=Yule|primeiro=George Udny|ultimo2=Kendall|primeiro2=Maurice|data=1950|editora=C. Griffin|lingua=en}}</ref> Nesta denominação, o "posto" de uma observação é substituído pelo "grau". Em distribuições contínuas, o grau de uma observação é, por convenção, sempre uma metade menor que o posto. Assim, as correlações entre graus e postos são iguais neste caso. De forma mais generalizada, o "grau" de uma observação é proporcional ao valor estimado da fração de uma população menor que um dado valor, com o ajuste da meia-observação nos valores observados. Assim, isto corresponde a um tratamento possível de postos empatados. Ainda que incomum, o termo "correlação de grau" ainda está em uso.<ref>{{citar periódico|ultimo=Piantadosi|primeiro=Julia|ultimo2=Howlett|primeiro2=Phil|ultimo3=Boland|primeiro3=John|ano=2007|mes=05|titulo=Matching the grade correlation coefficient using a copula with maximum disorder|jornal=Journal of Industrial and Management Optimization|volume=3|numero=2|doi=|url=http://aimsciences.org/journals/pdfs.jsp?paperID=2265&mode=abstract|acessadoem=19/07/2017}}</ref> |

|||

==Interpretação== |

|||

O sinal da correlação de Spearman indica a direção da associação entre <math>X</math> (a variável independente) e <math>Y</math> (a variável dependente). Se <math>Y</math> tende a aumentar quando <math>X</math> aumenta, o coeficiente de correlação de Spearman é positivo. Se <math>Y</math> tende a diminuir quando <math>X</math> aumenta, o coeficiente de correlação de Spearman é negativo. Um coeficiente de Spearman igual a zero indica que não há tendência de que <math>Y</math> aumente ou diminua quando <math>X</math> aumenta. A correlação de Spearman aumenta em magnitude conforme <math>X</math> e <math>Y</math> ficam mais próximas de serem funções monótonas perfeitas uma da outra. Quando <math>X</math> e <math>Y</math> são perfeitamente monotonamente relacionadas, o coeficiente de correlação de Spearman se torna 1. Uma relação crescente monótona perfeita implica que, para quaisquer dois pares de valores de dados <math>X_i,Y_i</math> e <math>X_j,Y_j</math>, {{math|''X''<sub>''i''</sub> − ''X''<sub>''j''</sub>}} e {{math|''Y''<sub>''i''</sub> − ''Y''<sub>''j''</sub>}} terão sempre o mesmo sinal. Uma relação decrescente monótona perfeita implica que estas diferenças terão sempre sinais opostos. |

|||

O coeficiente de correlação de Spearman é frequentemente descrito como sendo "não paramétrico". Isto pode ter dois sentidos. Em primeiro lugar, uma correlação de Spearman perfeita ocorre quando <math>X</math> e <math>Y</math> estão relacionados por qualquer função monótona, em contraste com a correlação de Pearson, que só dá um valor perfeito quando <math>X</math> e <math>Y</math> estão relacionadas por uma função linear. O outro sentido em que a correlação de Spearman é não paramétrica se refere ao fato de que sua exata distribuição de amostragem pode ser obtida sem conhecimento (isto é, sem informação sobre os parâmetros) quanto à [[distribuição de probabilidade]] conjunta de <math>X</math> e <math>Y</math>.<ref>{{Citar livro|url=https://books.google.com.br/books?id=T3qOqdpSz6YC&printsec=frontcover&dq=%C2%A0Nonparametric+Statistics:+A+Step-by-Step+Approach&hl=pt-BR&sa=X&redir_esc=y#v=onepage&q=%C2%A0Nonparametric%20Statistics:%20A%20Step-by-Step%20Approach&f=false|título=Nonparametric Statistics for Non-Statisticians: A Step-by-Step Approach|ultimo=Corder|primeiro=Gregory W.|ultimo2=Foreman|primeiro2=Dale I.|data=2011-09-20|editora=John Wiley & Sons|lingua=en|isbn=9781118211250}}</ref> |

|||

==Exemplo== |

|||

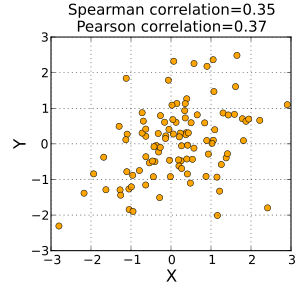

[[File:spearman fig2.svg|300px|thumb|Quando os dados são aproximadamente distribuídos de forma elíptica e não há [[Outlier|''outliers'']] proeminentes, a correlação de Spearman e a correlação de Pearson dão valores semelhantes.]] |

|||

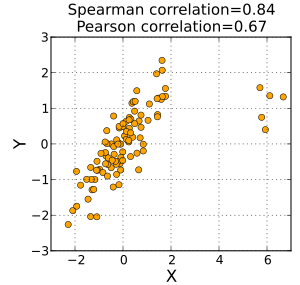

[[File:spearman fig3.svg|300px|thumb|A correlação de Spearman é menos sensível do que a correlação de Pearson a fortes ''outliers'' nas caudas de ambas as amostras. Isto se dá porque o rô de Spearman limita o ''outlier'' ao valor de seu posto.]] |

|||

Neste exemplo, os dados brutos na tabela abaixo são usados para calcular a correlação entre o [[QI]] de uma pessoa e o número de horas em que assiste [[televisão]] por semana. |

|||

{| class="wikitable sortable" style="text-align:right;" |

|||

|- |

|- |

||

!QI, <math>X_i</math> |

|||

!Horas de TV por semana, <math>Y_i</math> |

|||

|- |

|- |

||

|106 |

|106 |

||

| Linha 63: | Linha 91: | ||

|} |

|} |

||

Primeiro, |

Primeiro, é necessário achar o valor do termo <math>d^2_i</math>. Para fazer isto, executam-se os seguintes passos, refletidos na tabela abaixo: |

||

# Ordene os dados de acordo com a primeira coluna (<math>X_i</math>). Crie uma nova coluna <math>x_i</math> e atribua a esta coluna os valores dos postos <math>1,2,3,...,n</math>; |

|||

# Em seguida, ordene os dados de acordo com a segunda coluna (<math>Y_i</math>). Crie uma quarta coluna <math>y_i</math> e, analogamente, atribua a esta coluna os valores dos postos <math>1,2,3,...,n</math>; |

|||

# Crie uma quinta coluna <math>d_i</math> para conter as diferenças entre os postos das duas colunas <math>x_i</math> e <math>y_i</math>; |

|||

# Crie uma última coluna <math>d^2_i</math> para conter os quadrados dos valores da coluna <math>d_i</math>. |

|||

{| class="wikitable sortable" style="text-align:right;" |

|||

# Ordene os dados pela primeira coluna (<math>X_i</math>). Crie uma nova coluna <math>x_i</math> e escreva nela os valores dos postos 1,2,3,...''n''. |

|||

# Em seguida, ordene os dados pela segunda coluna (<math>Y_i</math>). Crie uma quarta coluna <math>y_i</math> e analogamente coloque os valores dos postos 1,2,3,...''n''. |

|||

# Crie uma quinta coluna <math>d_i</math> para conter as diferenças entre as duas colunas de postos (<math>x_i</math> e <math>y_i</math>). |

|||

# Crie uma última coluna <math>d^2_i</math> para conter os valores da coluna <math>d_i</math> ao quadrado. |

|||

{| class="wikitable" |

|||

|- |

|- |

||

!QI, <math>X_i</math> |

|||

!Horas de [[TV]] por semana, <math>Y_i</math> |

|||

!posto <math>x_i</math> |

|||

!posto <math>y_i</math> |

|||

!<math>d_i</math> |

|||

!<math>d^2_i</math> |

|||

|- |

|- |

||

|86 |

|86 |

||

| Linha 90: | Linha 117: | ||

|2 |

|2 |

||

|6 |

|6 |

||

| −4 |

|||

| −4 |

|||

|16 |

|16 |

||

|- |

|- |

||

| Linha 97: | Linha 124: | ||

|3 |

|3 |

||

|8 |

|8 |

||

| −5 |

|||

| −5 |

|||

|25 |

|25 |

||

|- |

|- |

||

| Linha 104: | Linha 131: | ||

|4 |

|4 |

||

|7 |

|7 |

||

| −3 |

|||

| −3 |

|||

|9 |

|9 |

||

|- |

|- |

||

| Linha 111: | Linha 138: | ||

|5 |

|5 |

||

|10 |

|10 |

||

| −5 |

|||

| −5 |

|||

|25 |

|25 |

||

|- |

|- |

||

| Linha 118: | Linha 145: | ||

|6 |

|6 |

||

|9 |

|9 |

||

| −3 |

|||

| −3 |

|||

|9 |

|9 |

||

|- |

|- |

||

| Linha 150: | Linha 177: | ||

|} |

|} |

||

Calculados os valores <math>d^2_i</math>, são somados para encontrar <math>\sum d_i^2 = 194</math>. O valor de <math>n</math> é 10. Agora, estes valores podem ser substituidos na equação <math> \rho = 1- {\frac {6 \sum d_i^2}{n(n^2 - 1)}}</math>: |

|||

:<math> \rho |

:<math> \rho=1-{\frac{6\times194}{10(10^2-1)}},</math> |

||

o que resulta em {{math|1=''ρ'' = −29/165 = −0,175757575...}} com um [[valor-p]] igual a 0,627188, usando a [[distribuição t de Student]]. |

|||

Que fornecem ''ρ'' = −0.175757575... |

|||

Com um [[Valor-p|valor-P]] = 0.6864058 (usando a [[Distribuição t de Student|Distribuição-t]]) |

|||

Este valor baixo mostra que a correlação entre QI e número de horas na frente da TV é muito baixa, ainda que o valor negativo sugira que, quanto mais tempo se passa assistindo televisão, mais baixo o QI. No caso de empates nos dados originais, esta fórmula não deve ser usada. Em vez disso, o coeficiente de correlação de Pearson deve ser calculado nos postos (quando se atribuem postos aos empates, como descrito acima). |

|||

Este valor pequeno mostra que a correlação entre QI e o número de horas assistindo TV é pequena. |

|||

==Determinação da significância== |

|||

obs. Se existem dados com o mesmo posto (dados iguais), o posto dos valores que são iguais é a média dos postos que lhes corresponderiam se não fossem iguais. |

|||

[[File:Spearman's Rank chart.png|300px|thumb|Gráfico dos dados apresentados. É possível observar que pode haver uma correlação negativa, mas que a relação não parece definitiva.]] |

|||

Uma abordagem para testar se um valor observado de <math>\rho</math> é significantemente diferente de zero (<math>r</math> sempre se manterá entre -1 e 1) consiste em calcular a probabilidade de que seria maior ou igual ao <math>r</math> observado, dada a [[hipótese nula]], ao usar um [[Reamostragem (estatística)|teste de permutação]]. Uma vantagem desta abordagem é que ela automaticamente leva em conta o número de valores empatados de dados na amostra e a forma como são tratados ao computar a correlação de postos.<ref>{{Citar periódico|ultimo=Bonett|primeiro=Douglas G.|ultimo2=Wright|primeiro2=Thomas A.|data=2000-03-01|titulo=Sample size requirements for estimating pearson, kendall and spearman correlations|jornal=Psychometrika|volume=65|numero=1|paginas=23–28|issn=0033-3123|doi=10.1007/BF02294183|url=https://link.springer.com/article/10.1007/BF02294183|idioma=en}}</ref> |

|||

Uma abordagem faz paralelo ao uso da transformação de Fisher no caso do coeficiente de correlação produto-momento de Pearson, isto é, [[Intervalo de confiança|intervalos de confiança]] e [[testes de hipóteses]] relativos ao valor da população <math>\rho</math> podem ser conduzidos usando a transformação de Fisher:<ref>{{Citar periódico|ultimo=Caruso|primeiro=John C.|ultimo2=Cliff|primeiro2=Norman|data=2016-07-02|titulo=Empirical Size, Coverage, and Power of Confidence Intervals for Spearman's Rho|jornal=Educational and Psychological Measurement|volume=57|numero=4|paginas=637–654|doi=10.1177/0013164497057004009|url=http://journals.sagepub.com/doi/10.1177/0013164497057004009|idioma=en}}</ref> |

|||

Ex: |

|||

{| class="wikitable" |

|||

|- |

|||

|QI, <math>X_i</math> |

|||

|Horas de TV por semana, <math>Y_i</math> |

|||

|- |

|||

|106 |

|||

|7 |

|||

|- |

|||

|86 |

|||

|0 |

|||

|- |

|||

|100 |

|||

|28 |

|||

|- |

|||

|100 |

|||

|50 |

|||

|- |

|||

|99 |

|||

|28 |

|||

|- |

|||

|103 |

|||

|28 |

|||

|- |

|||

|97 |

|||

|20 |

|||

|- |

|||

|113 |

|||

|12 |

|||

|- |

|||

|113 |

|||

|7 |

|||

|- |

|||

|110 |

|||

|17 |

|||

|} |

|||

:<math>F(r) = {1 \over 2}\ln{1+r \over 1-r} = \operatorname{artanh}(r).</math> |

|||

{| class="wikitable" |

|||

|- |

|||

|QI (i), <math>X_i</math> |

|||

|Horas de TV por semana (t), <math>Y_i</math> |

|||

|posto(i) |

|||

|posto(t) |

|||

|d |

|||

|d<sup>2</sup> |

|||

|- |

|||

|86 |

|||

|0 |

|||

|1 |

|||

|1 |

|||

|0 |

|||

|0 |

|||

|- |

|||

|97 |

|||

|20 |

|||

|2 |

|||

|6 |

|||

|4 |

|||

|16 |

|||

|- |

|||

|99 |

|||

|28 |

|||

|3 |

|||

|8 |

|||

|5 |

|||

|25 |

|||

|- |

|||

|100 |

|||

|50 |

|||

|4.5 |

|||

|10 |

|||

|5.5 |

|||

|30.25 |

|||

|- |

|||

|100 |

|||

|28 |

|||

|4.5 |

|||

|8 |

|||

|3.5 |

|||

|12.25 |

|||

|- |

|||

|103 |

|||

|28 |

|||

|6 |

|||

|8 |

|||

|2 |

|||

|4 |

|||

|- |

|||

|106 |

|||

|7 |

|||

|7 |

|||

|2.5 |

|||

|4.5 |

|||

|20.25 |

|||

|- |

|||

|110 |

|||

|17 |

|||

|8 |

|||

|5 |

|||

|3 |

|||

|9 |

|||

|- |

|||

|113 |

|||

|7 |

|||

|9.5 |

|||

|2.5 |

|||

|7 |

|||

|49 |

|||

|- |

|||

|113 |

|||

|12 |

|||

|9.5 |

|||

|4 |

|||

|5.5 |

|||

|30.25 |

|||

|} |

|||

Se <math>F(r)</math> for a transformação de Fisher de <math>r</math>, o coeficiente de correlação de postos de Spearman amostral, e <math>n</math> for o tamanho da amostra, então: |

|||

{{referências}} |

|||

:<math>z = \sqrt{\frac{n-3}{1.06}}F(r)</math> |

|||

é um escore padronizado para <math>r</math> que segue aproximadamente uma distribuição normal padrão sob a hipótese nula da independência estatística (<math>\rho=0</math>).<ref>{{Citar periódico|ultimo=Choi|primeiro=S. C.|data=1977-12-01|titulo=Tests of equality of dependent correlation coefficients|jornal=Biometrika|volume=64|numero=3|paginas=645–647|issn=0006-3444|doi=10.1093/biomet/64.3.645|url=https://academic.oup.com/biomet/article/64/3/645/297694/Tests-of-equality-of-dependent-correlation}}</ref><ref>{{Citar periódico|ultimo=Fieller|primeiro=E. C.|ultimo2=Hartley|primeiro2=H. O.|ultimo3=Pearson|primeiro3=E. S.|data=1957-12-01|titulo=TESTS FOR RANK CORRELATION COEFFICIENTS. I|jornal=Biometrika|volume=44|numero=3-4|paginas=470–481|issn=0006-3444|doi=10.1093/biomet/44.3-4.470|url=https://academic.oup.com/biomet/article/44/3-4/470/238829/TESTS-FOR-RANK-CORRELATION-COEFFICIENTS-I}}</ref> |

|||

=={{Ver também}}== |

|||

*[[Correlação]] |

|||

Pode-se também testar por significância usando: |

|||

*[[Coeficiente de correlação de Pearson]] |

|||

*[[Coeficiente de Correlação Ordinal]] |

|||

:<math>t = r \sqrt{\frac{n-2}{1-r^2}}</math> |

|||

que é aproximadamente distribuído como a distribuição t de Student com <math>n-2</math> graus de liberdade sob a hipótese nula.<ref>{{Citar livro|url=https://books.google.com.br/books?id=kJG4MgEACAAJ&dq=Vettering+Flannery+Numerical+Recipes+in+C:+The+Art+of+Scientific+Computing&hl=pt-BR&sa=X&redir_esc=y|título=Numerical Recipes in C++: The Art of Scientific Computing|ultimo=Press|primeiro=William H.|ultimo2=Teukolsky|primeiro2=Saul A.|ultimo3=Vetterling|primeiro3=William T.|ultimo4=Flannery|primeiro4=Brian P.|data=2002-02-07|editora=Cambridge University Press|lingua=en|isbn=9780521750332}}</ref> Uma justificação para este resultado se baseia em um argumento de permutação.<ref>{{Citar livro|url=https://books.google.com.br/books?id=elabQwAACAAJ&dq=The+Advanced+Theory+of+Statistics,+Volume+2:+Inference+and+Relationship&hl=pt-BR&sa=X&ved=0ahUKEwizoIi_oZjVAhXHhpAKHd-_BAYQ6AEILzAB|título=The Advanced Theory of Statistics. Vol. 2: Inference and: Relationsship|data=1973|editora=Griffin|lingua=en}}</ref> |

|||

Uma generalização do coeficiente de Spearman é útil na situação em que há três ou mais condições, uma quantidade de sujeitos é toda observada em cada uma delas e se prevê que as observações terão uma ordem particular. Por exemplo, cada sujeito deste grupo será avaliado três vezes fazendo a mesma tarefa e se prevê que a performance melhorará a cada avaliação. Um teste da significância da tendência entre condições nesta situação foi desenvolvido por Ellis Batten Page, sendo usualmente chamado de teste de tendência de Page para alternativas ordenadas.<ref>{{Citar periódico|ultimo=Page|primeiro=Ellis Batten|data=1963-03-01|titulo=Ordered Hypotheses for Multiple Treatments: A Significance Test for Linear Ranks|jornal=Journal of the American Statistical Association|volume=58|numero=301|paginas=216–230|issn=0162-1459|doi=10.2307/2282965|url=http://www.tandfonline.com/doi/abs/10.1080/01621459.1963.10500843}}</ref> |

|||

==Análise de correspondência baseada no rô de Spearman== |

|||

A análise de correspondência clássica é um método estatístico que dá um escore para todo valor de duas variáveis nominais. Desta forma, o coeficiente de correlação de Pearson entre eles é maximizado. |

|||

Há um equivalente deste método, chamado de análise de correspondência de grau, que maximiza o rô de Spearman e o tau de Kendall.<ref>{{Citar livro|url=https://books.google.com.br/books?id=7GXpCAAAQBAJ&pg=PA6&dq=Grade+Models+and+Methods+for+Data+Analysis+with+Applications+for+the+Analysis+of+Data+Populations.&hl=pt-BR&sa=X&ved=0ahUKEwjyif_9oZjVAhVJkZAKHWQ-AlEQ6AEIJzAA#v=onepage&q=Grade%20Models%20and%20Methods%20for%20Data%20Analysis%20with%20Applications%20for%20the%20Analysis%20of%20Data%20Populations.&f=false|título=Grade Models and Methods for Data Analysis: With Applications for the Analysis of Data Populations|ultimo=Kowalczyk|primeiro=Teresa|ultimo2=Pleszczynska|primeiro2=Elzbieta|ultimo3=Ruland|primeiro3=Frederick|data=2012-12-06|editora=Springer|lingua=en|isbn=9783540399285}}</ref> |

|||

==Ver também== |

|||

* [[Coeficiente de correlação de Pearson]] |

|||

* [[Coeficiente de correlação tau de Kendall]] |

|||

* [[Desigualdade do rearranjo]] |

|||

==Referências== |

|||

{{Reflist}} |

|||

==Ligações externas== |

|||

*[http://www.crystalballservices.com/Resources/ConsultantsCornerBlog/EntryId/73/Copulas-Vs-Correlation.aspx Cópulas ''vs.'' Correlações por Eric Torkia para Crystal Ball Analytics Services] (em inglês) |

|||

*[http://www.sussex.ac.uk/Users/grahamh/RM1web/Rhotable.htm Tabela de valores críticos de ''ρ'' para significância com amostras pequenas no portal da Universidade de Sussex] (em inglês) |

|||

*[http://vassarstats.net/textbook/ch3pt1.html Fórmula usada quando há empates no ''VassarStats''] (em inglês) |

|||

*[http://www.biostathandbook.com/spearman.html Coeficiente de correlação de postos de Spearman no ''Handbook of Biological Statistics''] (em inglês) |

|||

{{Estatística}} |

{{Estatística}} |

||

{{Portal3|Probabilidade e estatística}} |

|||

[[Categoria:Covariância e correlação]][[Categoria:Estatística]][[Categoria:Testes estatísticos]] |

|||

{{Portal3|Probabilidade e Estatística}} |

|||

[[Categoria:Estatística]] |

|||

Revisão das 19h39min de 20 de julho de 2017

| Estatística |

|---|

|

Em estatística, o coeficiente de correlação de postos de Spearman ou rô de Spearman, que recebe este nome em homenagem ao psicólogo e estatístico Charles Spearman, frequentemente denotado pela letra grega (rô) ou , é uma medida não paramétrica de correlação de postos (dependência estatística entre a classificação de duas variáveis). O coeficiente avalia com que intensidade a relação entre duas variáveis pode ser descrita pelo uso de uma função monótona.[1] A correlação de Spearman entre duas variáveis é igual à correlação de Pearson entre os valores de postos daquelas duas variáveis. Enquanto a correlação de Pearson avalia relações lineares, a correlação de Spearman avalia relações monótonas, sejam elas lineares ou não.[2] Se não houver valores de dados repetidos, uma correlação de Spearman perfeita de +1 ou -1 ocorre quando cada uma das variáveis é uma função monótona perfeita da outra.

Intuitivamente, a correlação de Spearman entre duas variáveis será alta quando observações tiverem uma classificação semelhante (ou idêntica no caso da correlação igual a 1) entre as duas variáveis, isto é, a posição relativa das observações no interior da variável (1º, 2º, 3º, etc.), e baixa quando observações tiverem uma classificação dessemelhante (ou completamente oposta no caso da correlação igual a -1) entre as duas variáveis.

O coeficiente de Spearman é apropriado tanto para variáveis contínuas, como para variáveis discretas, incluindo variáveis ordinais.[3] Tanto o de Spearman, como o de Kendall pode ser formulados como casos especiais de um coeficiente de correlação mais geral.

Definição e cálculo

O coeficiente de correlação de Spearman é definido como o coeficiente de correlação de Pearson entre variáveis classificadas em postos.[4]

Para uma amostra de tamanho , os dados brutos são convertidos em postos e é computado a partir de:

- em que

- denota o usual coeficiente de correlação de Pearson, mas aplicado às variáveis em postos;

- é a covariância das variáveis em postos;

- e são os desvios padrão das variáveis em postos.[5]

Apenas se todos os postos forem números inteiros distintos, o coeficiente pode ser calculado usando a fórmula popular:

Quando há valores idênticos, geralmente se atribui a cada valor um posto fracionário igual à média de suas posições na ordem ascendente dos valores, que é equivalente ao cálculo da média de todas as permutações possíveis.[8]

Se valores repetidos estiverem presentes nos conjuntos de dados, a equação produz resultados incorretos. Apenas se, em ambas as variáveis, todos os postos forem distintos, então, (vide número tetraédrico ). A primeira equação — normalizando pelo desvio padrão — pode ser usada até mesmo quando os postos forem normalizados a ("postos relativos"), porque não é sensível tanto à translação, quanto ao escalonamento linear.

Este método também não deve ser usado em casos em que o conjunto de dados estiver truncado, isto é, quando o coeficiente de correlação de Spearman for desejado para os registros do topo (seja pelos postos pré-mudança, pelos postos pós-mudança ou ambos). Neste caso, deve-se usar a fórmula do coeficiente de correlação de Pearson descrita acima.

O erro padrão do coeficiente foi determinado pelo estatístico britânico Karl Pearson em 1907 e pelo matemático britânico Thorold Gosset em 1920, sendo:

Quantidades relacionadas

Há várias outras medidas numéricas que quantificam a intensidade da dependência estatística entre parers de observações. A mais comum é o coeficiente de correlação produto-momento de Pearson, que é um método de correlação semelhante ao coeficiente de correlação de postos de Spearman, que mede as relações "lineares" entre números brutos, não entre seus postos.

Um nome alternativo para a correlação de postos de Spearman é "correlação de grau".[9] Nesta denominação, o "posto" de uma observação é substituído pelo "grau". Em distribuições contínuas, o grau de uma observação é, por convenção, sempre uma metade menor que o posto. Assim, as correlações entre graus e postos são iguais neste caso. De forma mais generalizada, o "grau" de uma observação é proporcional ao valor estimado da fração de uma população menor que um dado valor, com o ajuste da meia-observação nos valores observados. Assim, isto corresponde a um tratamento possível de postos empatados. Ainda que incomum, o termo "correlação de grau" ainda está em uso.[10]

Interpretação

O sinal da correlação de Spearman indica a direção da associação entre (a variável independente) e (a variável dependente). Se tende a aumentar quando aumenta, o coeficiente de correlação de Spearman é positivo. Se tende a diminuir quando aumenta, o coeficiente de correlação de Spearman é negativo. Um coeficiente de Spearman igual a zero indica que não há tendência de que aumente ou diminua quando aumenta. A correlação de Spearman aumenta em magnitude conforme e ficam mais próximas de serem funções monótonas perfeitas uma da outra. Quando e são perfeitamente monotonamente relacionadas, o coeficiente de correlação de Spearman se torna 1. Uma relação crescente monótona perfeita implica que, para quaisquer dois pares de valores de dados e , Xi − Xj e Yi − Yj terão sempre o mesmo sinal. Uma relação decrescente monótona perfeita implica que estas diferenças terão sempre sinais opostos.

O coeficiente de correlação de Spearman é frequentemente descrito como sendo "não paramétrico". Isto pode ter dois sentidos. Em primeiro lugar, uma correlação de Spearman perfeita ocorre quando e estão relacionados por qualquer função monótona, em contraste com a correlação de Pearson, que só dá um valor perfeito quando e estão relacionadas por uma função linear. O outro sentido em que a correlação de Spearman é não paramétrica se refere ao fato de que sua exata distribuição de amostragem pode ser obtida sem conhecimento (isto é, sem informação sobre os parâmetros) quanto à distribuição de probabilidade conjunta de e .[11]

Exemplo

Neste exemplo, os dados brutos na tabela abaixo são usados para calcular a correlação entre o QI de uma pessoa e o número de horas em que assiste televisão por semana.

| QI, | Horas de TV por semana, |

|---|---|

| 106 | 7 |

| 86 | 0 |

| 100 | 27 |

| 101 | 50 |

| 99 | 28 |

| 103 | 29 |

| 97 | 20 |

| 113 | 12 |

| 112 | 6 |

| 110 | 17 |

Primeiro, é necessário achar o valor do termo . Para fazer isto, executam-se os seguintes passos, refletidos na tabela abaixo:

- Ordene os dados de acordo com a primeira coluna (). Crie uma nova coluna e atribua a esta coluna os valores dos postos ;

- Em seguida, ordene os dados de acordo com a segunda coluna (). Crie uma quarta coluna e, analogamente, atribua a esta coluna os valores dos postos ;

- Crie uma quinta coluna para conter as diferenças entre os postos das duas colunas e ;

- Crie uma última coluna para conter os quadrados dos valores da coluna .

| QI, | Horas de TV por semana, | posto | posto | ||

|---|---|---|---|---|---|

| 86 | 0 | 1 | 1 | 0 | 0 |

| 97 | 20 | 2 | 6 | −4 | 16 |

| 99 | 28 | 3 | 8 | −5 | 25 |

| 100 | 27 | 4 | 7 | −3 | 9 |

| 101 | 50 | 5 | 10 | −5 | 25 |

| 103 | 29 | 6 | 9 | −3 | 9 |

| 106 | 7 | 7 | 3 | 4 | 16 |

| 110 | 17 | 8 | 5 | 3 | 9 |

| 112 | 6 | 9 | 2 | 7 | 49 |

| 113 | 12 | 10 | 4 | 6 | 36 |

Calculados os valores , são somados para encontrar . O valor de é 10. Agora, estes valores podem ser substituidos na equação :

o que resulta em ρ = −29/165 = −0,175757575... com um valor-p igual a 0,627188, usando a distribuição t de Student.

Este valor baixo mostra que a correlação entre QI e número de horas na frente da TV é muito baixa, ainda que o valor negativo sugira que, quanto mais tempo se passa assistindo televisão, mais baixo o QI. No caso de empates nos dados originais, esta fórmula não deve ser usada. Em vez disso, o coeficiente de correlação de Pearson deve ser calculado nos postos (quando se atribuem postos aos empates, como descrito acima).

Determinação da significância

Uma abordagem para testar se um valor observado de é significantemente diferente de zero ( sempre se manterá entre -1 e 1) consiste em calcular a probabilidade de que seria maior ou igual ao observado, dada a hipótese nula, ao usar um teste de permutação. Uma vantagem desta abordagem é que ela automaticamente leva em conta o número de valores empatados de dados na amostra e a forma como são tratados ao computar a correlação de postos.[12]

Uma abordagem faz paralelo ao uso da transformação de Fisher no caso do coeficiente de correlação produto-momento de Pearson, isto é, intervalos de confiança e testes de hipóteses relativos ao valor da população podem ser conduzidos usando a transformação de Fisher:[13]

Se for a transformação de Fisher de , o coeficiente de correlação de postos de Spearman amostral, e for o tamanho da amostra, então:

é um escore padronizado para que segue aproximadamente uma distribuição normal padrão sob a hipótese nula da independência estatística ().[14][15]

Pode-se também testar por significância usando:

que é aproximadamente distribuído como a distribuição t de Student com graus de liberdade sob a hipótese nula.[16] Uma justificação para este resultado se baseia em um argumento de permutação.[17]

Uma generalização do coeficiente de Spearman é útil na situação em que há três ou mais condições, uma quantidade de sujeitos é toda observada em cada uma delas e se prevê que as observações terão uma ordem particular. Por exemplo, cada sujeito deste grupo será avaliado três vezes fazendo a mesma tarefa e se prevê que a performance melhorará a cada avaliação. Um teste da significância da tendência entre condições nesta situação foi desenvolvido por Ellis Batten Page, sendo usualmente chamado de teste de tendência de Page para alternativas ordenadas.[18]

Análise de correspondência baseada no rô de Spearman

A análise de correspondência clássica é um método estatístico que dá um escore para todo valor de duas variáveis nominais. Desta forma, o coeficiente de correlação de Pearson entre eles é maximizado.

Há um equivalente deste método, chamado de análise de correspondência de grau, que maximiza o rô de Spearman e o tau de Kendall.[19]

Ver também

- Coeficiente de correlação de Pearson

- Coeficiente de correlação tau de Kendall

- Desigualdade do rearranjo

Referências

- ↑ Spearman, C. (1904). «The Proof and Measurement of Association between Two Things». The American Journal of Psychology. 15 (1): 72–101. doi:10.2307/1412159

- ↑ Kendall, Maurice George; Gibbons, Jean Dickinson (1990). Rank correlation methods (em inglês). [S.l.]: E. Arnold

- ↑ Lehman, Ann; O'Rourke, Norm; Hatcher, Larry; Stepanski, Edward (2013). JMP for Basic Univariate and Multivariate Statistics: Methods for Researchers and Social Scientists, Second Edition (em inglês). [S.l.]: SAS Institute. ISBN 9781612906034

- ↑ Myers, Jerome L.; Well, Arnold D.; Jr, Robert F. Lorch (11 de janeiro de 2013). Research Design and Statistical Analysis: Third Edition (em inglês). [S.l.]: Routledge. ISBN 9781135811631

- ↑ Daniel, Wayne W. (30 de junho de 2000). Applied Nonparametric Statistics (em inglês). [S.l.]: Duxbury. ISBN 9780534381943

- ↑ Hollander, Myles; Wolfe, Douglas A.; Chicken, Eric (25 de novembro de 2013). Nonparametric Statistical Methods (em inglês). [S.l.]: John Wiley & Sons. ISBN 9781118553299

- ↑ Spiegel, M. R. (1985). Estatistica; resumo da teoria 875 problemas resolvidos 619 problemas propostos. [S.l.]: Fundacao CARGILL

- ↑ Dodge, Yadolah (15 de abril de 2008). The Concise Encyclopedia of Statistics (em inglês). [S.l.]: Springer Science & Business Media. ISBN 9780387317427

- ↑ Yule, George Udny; Kendall, Maurice (1950). An Introduction to the Theory of Statistics. G. Udny Yule, ... and M.G. Kendall, ... 14th Edition Revised and Enlarged (em inglês). [S.l.]: C. Griffin

- ↑ Piantadosi, Julia; Howlett, Phil; Boland, John (maio de 2007). «Matching the grade correlation coefficient using a copula with maximum disorder». Journal of Industrial and Management Optimization. 3 (2). Consultado em 19 de julho de 2017

- ↑ Corder, Gregory W.; Foreman, Dale I. (20 de setembro de 2011). Nonparametric Statistics for Non-Statisticians: A Step-by-Step Approach (em inglês). [S.l.]: John Wiley & Sons. ISBN 9781118211250

- ↑ Bonett, Douglas G.; Wright, Thomas A. (1 de março de 2000). «Sample size requirements for estimating pearson, kendall and spearman correlations». Psychometrika (em inglês). 65 (1): 23–28. ISSN 0033-3123. doi:10.1007/BF02294183

- ↑ Caruso, John C.; Cliff, Norman (2 de julho de 2016). «Empirical Size, Coverage, and Power of Confidence Intervals for Spearman's Rho». Educational and Psychological Measurement (em inglês). 57 (4): 637–654. doi:10.1177/0013164497057004009

- ↑ Choi, S. C. (1 de dezembro de 1977). «Tests of equality of dependent correlation coefficients». Biometrika. 64 (3): 645–647. ISSN 0006-3444. doi:10.1093/biomet/64.3.645

- ↑ Fieller, E. C.; Hartley, H. O.; Pearson, E. S. (1 de dezembro de 1957). «TESTS FOR RANK CORRELATION COEFFICIENTS. I». Biometrika. 44 (3-4): 470–481. ISSN 0006-3444. doi:10.1093/biomet/44.3-4.470

- ↑ Press, William H.; Teukolsky, Saul A.; Vetterling, William T.; Flannery, Brian P. (7 de fevereiro de 2002). Numerical Recipes in C++: The Art of Scientific Computing (em inglês). [S.l.]: Cambridge University Press. ISBN 9780521750332

- ↑ The Advanced Theory of Statistics. Vol. 2: Inference and: Relationsship (em inglês). [S.l.]: Griffin. 1973

- ↑ Page, Ellis Batten (1 de março de 1963). «Ordered Hypotheses for Multiple Treatments: A Significance Test for Linear Ranks». Journal of the American Statistical Association. 58 (301): 216–230. ISSN 0162-1459. doi:10.2307/2282965

- ↑ Kowalczyk, Teresa; Pleszczynska, Elzbieta; Ruland, Frederick (6 de dezembro de 2012). Grade Models and Methods for Data Analysis: With Applications for the Analysis of Data Populations (em inglês). [S.l.]: Springer. ISBN 9783540399285

Ligações externas

- Cópulas vs. Correlações por Eric Torkia para Crystal Ball Analytics Services (em inglês)

- Tabela de valores críticos de ρ para significância com amostras pequenas no portal da Universidade de Sussex (em inglês)

- Fórmula usada quando há empates no VassarStats (em inglês)

- Coeficiente de correlação de postos de Spearman no Handbook of Biological Statistics (em inglês)

![{\displaystyle [0;1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/bc3bf59a5da5d8181083b228c8933efbda133483)