Sistema de equações lineares

Em Matemática, um sistema de equações lineares (abreviadamente, sistema linear) é um conjunto finito de equações lineares aplicadas num mesmo conjunto, igualmente finito, de variáveis.[1] Por exemplo,

é um sistema de três equações com três variáveis (x, y e z). Uma solução para um sistema linear é uma atribuição de números às incógnitas que satisfazem simultaneamente todas as equações do sistema. Uma solução para o sistema acima é dada por

já que esses valores tornam válidas as três equações do sistema em questão. A palavra "sistema" indica que as equações devem ser consideradas em conjunto, e não de forma individual, isto é, cada uma das equações precisa ser satisfeita.

Em matemática, a teoria de sistemas lineares é a base e uma parte fundamental da álgebra linear, um tema que é usado na maior parte da matemática moderna. Deve-se observar que, em primeiro lugar, a equação linear é, necessariamente, uma equação polinomial. Em diversos ramos da matemática aplicada e ciências naturais, podemos encontrar vários usos de sistemas lineares. Exemplos são a física, a economia, a engenharia, a biologia, a geografia, a navegação, a aviação, a cartografia, a demografia e a astronomia.[2]

Algoritmos computacionais são para encontrar soluções constituem uma parte importante da álgebra linear numérica, e desempenham um papel proeminente nas áreas de aplicação da álgebra linear. Tais métodos têm uma grande importância para obter soluções rápidas e acuradas.[3] Pode-se muitas vezes aproximar um sistema de equações não-lineares por um sistema linear, uma técnica chamada de linearização e útil ao elaborar modelos matemáticos ou realizar simulações computacionais de um sistema mais complexo.

O sistema linear também pode ser conceituado como um sistema de equações do primeiro grau, ou seja, um sistema no qual as equações possuem apenas polinômios em que cada parcela tem apenas uma incógnita. Em outras palavras, num sistema linear, não há potência diferente de um ou zero e tampouco pode haver multiplicação entre incógnitas.

Muitas vezes, os coeficientes das equações são números reais ou complexos e as soluções são procuradas no mesmo conjunto de números, mas a teoria e os algoritmos aplicam os coeficientes e soluções em qualquer campo.

Exemplo básico[editar | editar código-fonte]

O tipo mais simples de sistema linear envolve duas equações e duas variáveis:

Forma geral[editar | editar código-fonte]

Um sistema geral de m equações lineares com n incógnitas pode ser escrito como:

Aqui, são as incógnitas, são os coeficientes do sistema e são os termos constantes.[4]

Muitas vezes, os coeficientes e as incógnitas são números reais ou complexos, mas pode-se encontrar também números inteiros e racionais, já que são polinômios e elementos de uma estrutura algébrica abstrata.

Equação vetorial[editar | editar código-fonte]

Um ponto de vista extremamente útil é que cada incógnita é um peso para um vetor coluna em uma combinação linear.

Isso permite que seja exercida toda a linguagem e teoria dos espaços vetoriais (ou, mais geralmente, módulos). Por exemplo: o espaço vetorial gerado é o conjunto de todas as possíveis combinações lineares dos vetores sobre o lado esquerdo, e as equações têm uma solução apenas quando o vetor da mão direita se encontra nesse espaço vetorial gerado. Se cada vetor desse espaço vetorial gerado tem exatamente uma expressão como uma combinação linear dos vetores dados à esquerda, então qualquer solução é única. De qualquer maneira, o espaço vetorial gerado tem uma base de vetores linearmente independentes que garantem exatamente uma expressão; e o número de vetores nessa base (a sua dimensão) não pode ser maior do que m ou n, mas pode ser menor. Isto é importante porque, se tivermos m vetores independentes, a solução é garantida, independentemente do lado direito, o que não ocorre de outra forma.

Equação matricial[editar | editar código-fonte]

A equação vetorial é equivalente a uma equação matricial da forma

Agora, o número de vetores em uma base para o espaço vetorial gerado é expresso como o posto da matriz.

O método matricial pode ser usado para resolver sistemas de equações lineares em que o número de incógnitas é igual ao número de equações, ou seja, sistemas de equações linear com uma matriz quadrada dos coeficientes das incógnitas.

Outra condição para a aplicabilidade do método matricial é a não degeneração da matriz de coeficientes para incógnitas, ou seja, o determinante da matriz deve ser diferente de zero.

O sistema de equações lineares, quando as condições acima são satisfeitas, pode ser representado em forma de matriz, e então resolvido encontrando a matriz inversa da matriz do sistema.

A solução dos sistemas de equações lineares pelo método da matriz baseia-se na seguinte propriedade da matriz inversa: o produto da matriz inversa e da matriz original é igual à matriz identidade. [5]

Que seja necessário resolver um sistema de equações lineares:

a11x1 + a12x2 + a13x3 = b1

a21x1 + a22x2 + a23x3 = b2

a31x1 + a32x2 + a33x3 = b3

Escrevemos este sistema de equações em forma de matriz:

| a11 a12 a13 | | x1 | | b1 | | a21 a22 a23 | x | x2 | = | b2 | | a31 a32 a33 | | x3 | | b3 |

Exemplo 1. Resolva o sistema de equações lineares pelo método da matriz:

2x1 - x2 = 1

3x1 + 5x2 = -1

A solução consiste nas seguintes etapas:

Etapa 1. Compomos as seguintes matrizes.

Matriz de coeficientes das incógnitas:

A = | 2 -1 |

| 3 5 |

Matriz de incógnitas:

X = | x1 |

| x2 |

Matriz de membros:

B = | 1 |

| -1 |

Verificar se a matriz de coeficientes para incógnitas é diferente de zero, ou seja, aplicar o método da matriz:

| A | = 2 . 5 - (-1) . 3 = 13

O determinante desta matriz não é igual a zero, portanto, podemos aplicar o método da matriz.

Etapa 2. Encontre a matriz inversa de coeficientes para incógnitas:

A-1 = 1/13 . | 5 1 |

| -3 2 |

Etapa 3. Encontre a matriz de valores desconhecidos:

X = 1/13 . | 5 1 | . | 1 | =

| -1 2 | | -1 |

= 1/13 . | 4 | = | 4/13 |

| -5 | | -5/13 |

Então, temos a solução:

x1 = 4/13, x2 = 5/13

Vamos checar:

2 . 4/13 - (-5/13) = 1

3 . 4/13 + 5 . (-5/13) = -1

Portanto, a resposta está correta.

Conceito[editar | editar código-fonte]

O sistema linear é correlacionada à álgebra linear e o entendimento mais profundo dos sistemas é dependente do domínio desta matéria.[6]

Sendo assim, é importante o entendimento dos espaços vetoriais, dos isomorfismos, das transformações lineares, da interpolação de Lagrange, da decomposição de um polinômio em fatores primos, de anéis comutativos, do teorema da decomposição primária, da forma de Jordan e das formas bilineares.

Um sistema linear, partindo da premissa de que tem resultado existente e determinado e não há dependência entre as equações, deve ter o mesmo número de equações e de incógnitas. O número de variáveis (incógnitas) também é chamado de quantidade de dimensões do problema. O número de dimensões está relacionado ao espaço vetorial. Por outro lado, os números que são subsumidos às incógnitas das equações podem ser de vários universos. Em geral, se resolvem sistemas para números reais, mas também existem sistemas para números complexos e ainda para outros tipos de números. Assim, para n dimensões no conjunto dos números reais, diz-se que se trabalha no conjunto ℝn.

Para que o resultado de um sistema seja existente e determinado, não pode haver redundância, o que é chamado também dependência entre as matrizes que representam as equações.

Histórico[editar | editar código-fonte]

A história dos sistemas de equações lineares começa no oriente. Em 1683, num trabalho do japonês Seki Kowa, surge a ideia de determinante[7] (como polinômio que se associa a um quadrado de números).

O uso de determinantes no Ocidente começou dez anos depois num trabalho de Leibniz, ligado também a sistemas lineares.

A conhecida regra de Cramer é na verdade uma descoberta do escocês Colin Maclaurin (1698-1746), datando provavelmente de 1729, embora só publicada postumamente em 1748 no seu Treatise of algebra.

O suíço Gabriel Cramer (1704-1752) não aparece nesse episódio de maneira totalmente gratuita. Cramer também chegou à regra independentemente.

O francês Étienne Bézout (1730-1783), autor de textos matemáticos de sucesso em seu tempo, tratou do assunto, sendo complementado posteriormente por Laplace, em Pesquisas sobre o cálculo integral e o sistema do mundo.

O termo determinante, com o sentido atual, surgiu em 1812 num trabalho de Cauchy sobre o assunto. Neste artigo, apresentado à Academia de Ciências, sugeriu a notação que hoje é aceita como convenção.

Já o alemão Jacobi fez a leitura dessa teoria da forma como atualmente se estuda.

Solução[editar | editar código-fonte]

A solução de um sistema linear é a atribuição de valores às variáveis x1, x2, ..., xn de modo a satisfazer ambas equações. O grupo de todas as soluções possíveis é chamado de conjunto solução.[8]

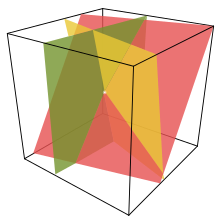

Um sistema linear pode comportar-se em qualquer uma das três formas possíveis:[9][10]

- Sistema Possível Determinado – S.P.D.: É o sistema que possui apenas uma única solução possível, quando o determinante é diferente de 0 (D ≠ 0). Esse sistema pode ser chamado de sistema possível e suas equações de equações compatíveis.

- Sistema Possível Indeterminado – S.P.I.: É o sistema que possui múltiplas soluções e o seu determinante é igual a zero (D = 0).

- Sistema Impossível – SI: É o sistema que não admite uma solução, sendo designado por sistema impossível e suas equações como equações incompatíveis. Nesse caso, o determinante principal é igual a zero (D = 0) e um ou mais determinantes secundários são diferentes de zero (D ≠ 0). [11]

Técnicas de resolução[editar | editar código-fonte]

Existem inúmeros métodos de resolução de sistemas, como distintas propriedades matemáticas. Para aplicações computacionais complexas, veja algebra liner computacional. Alguns métodos papel e lapis existem.

Eliminação de Gauss[editar | editar código-fonte]

O método de eliminação de Gauss, que também é conhecido como escalonamento é um método que consiste de manipular o sistema através de algumas operações elementares, que transforma a matriz estendida em uma matriz triangular, que após isso, a solução é obtida via substituição regressiva.

Seja Ax = b um sistema linear. O método de eliminação de Gauss para se encontrar a solução do sistema consiste nas seguintes etapas

- Etapa 1: Obter a matriz aumentada na forma que representa o sistema de equações.

- Etapa 2:Transformar a matriz aumentada em uma matriz aumentada na forma onde é uma matriz triangular superior.

- Etapa 3: Resolver o sistema linear da Etapa 2 por substituição regressiva.

Etapa 1[editar | editar código-fonte]

Considere o sistema linear de 3 equações abaixo:

A matriz aumentada A do sistema é:

=

Etapa 2[editar | editar código-fonte]

Fase 1[editar | editar código-fonte]

Deseja-se zerar todos os elementos da primeira coluna abaixo da diagonal principal. Assim, sendo define-se as constantes e e faz-se as seguintes operações lineares:

Obtendo-se:

Fase 2[editar | editar código-fonte]

Agora, deve-se zerar todos os elementos da segunda coluna abaixo da diagonal principal. Sendo o pivô o elemento e a linha pivô a linha 2 de supõe-se e define-se uma nova constante Realizando a operação

obtém-se:

- Note que é uma matriz aumentada cuja matriz é uma matriz triangular superior.

Etapa 3[editar | editar código-fonte]

Resolve-se o sistema Assim:

Assim, encontra-se a solução do sistema que é a mesma solução de

- Observação: o método da Eliminação de Gauss só poderá ser usado para resolver sistemas lineares associados a matrizes escalonadas reduzidas com elementos das suas diagonais principais não-nulos, ou seja,

Método da substituição[editar | editar código-fonte]

O método da substituição consiste em isolar uma incógnita em qualquer uma das equações, obtendo igualdade com um polinômio. Então deve-se substituir essa mesma incógnita em outra das equações pelo polinômio ao qual ela foi igualada.

Método da comparação[editar | editar código-fonte]

Consiste em compararmos as duas equações do sistema, após termos isolado a mesma variável (x ou y) nas duas equações. e as equações ficam mais detalhadas.

Método de Adição[editar | editar código-fonte]

O método de adição, é uma solução de sistemas lineares. Porem é mais usado quando se tem duas equações e duas incógnitas, Basicamente deve-se somar as equações a fim de cancelarmos uma variável no sistema.

Exemplo:

21x + y = 13

29x - y = 12

Podemos organiza-la para facilitar, deixando-a assim:

21x + 29x + y - y = 13 + 12Texto em subscrito

Resultando em:

21x + 29x = 13 + 12

50x = 25

x = 50 / 25 => 2

Assim encontramos o resultado da variável X, porem não acabou, temos que substituir o x na segunda equação

29x - y = 12

29(2) - y = 12

58 - y = 12

y = - 12 + 58

y = 46

Sendo assim, o conjunto solução é:

S ( x , y ) = (2 , 46)

Fatorizações de matrizes[editar | editar código-fonte]

Os métodos mais utilizados computacionalmente para resolver sistemas lineares envolvem fatorizações de matrizes. O mais conhecido, a eliminação de Gauss, origina a fatoração LU. Resolver o sistema Ax=b é equivalente a resolver os sistemas mais simples Ly=b e Ux=6.

Regra de Cramer[editar | editar código-fonte]

A Regra de Cramer é uma fórmula explícita para a solução de um sistema de equações lineares, com cada variável dada por um quociente de dois determinantes. Por exemplo, a solução para o sistema

é dada pela

Para cada variável, o denominador é a determinante da matriz de coeficientes, enquanto o numerador é o determinante de uma matriz na qual cada coluna foi substituída pelo vetor de termos constantes.

Embora a regra de Cramer seja importante teoricamente, tem pouco valor prático para grandes matrizes, uma vez que o cálculo de grandes determinantes é um processo computacionalmente custoso.

Além disso, a regra de Cramer tem pobres propriedades numéricas, tornando-a inadequada para resolver até mesmo pequenos sistemas de forma confiável, a menos que as operações forem executadas em aritmética racional com precisão ilimitada.

Método de Jacobi[editar | editar código-fonte]

O método de Jacobi é obtido a partir do sistema linear:

a11x1 + a12x2 + ... + a1nxn = y1

a21x1 + a22x2 + ... + a2nxn = y2

...

an1x1 + an2x2 + ... + annxn = yn

Agora, isolando x1 da primeira linha, obtemos:

x1(k+1) = y1 - (a12x2(k) + ... + a1nxn(k)) / a11

Fazendo isso para os próximos xi de cada equação linear, o resultado será algo como:

x1(k+1) = y1 - (a12x2(k) + ... + a1nxn(k)) / a11

x2(k+1) = y2 - (a21x2(k) + a23x3(k) + ... + a2nxn(k)) / a22

...

xn(k+1) = y2 - (an1x1(k) + ... + an,n-2xn-2(k) + an,n-1xn-1(k)) / ann

Uma forma mais abreviada de escrever a equação seria:

x(1) = aproximação inicial

xi(k+1) = (yi - Σj=1j ≠ in aijxj(k)) / aii

Logo, resolvendo o sistema linear abaixo via Método de Jacobi:

10x + y = 23

x + 8y = 26

Iniciando com x(1) = y(1) = 0.

x(k+1) = 23 - yk / 10

y(k+1) = 26 - xk / 8

x(2) = 23 - y(1) / 10 = 2,3

y(2) = 26 - x(1) / 8 = 3,25

x(3) = 23 - y(2) / 10 = 1,975

y(3) = 26 - x (2) / 8 = 2,9625[12]

Referências

- ↑ Poole, David (2005). Álgebra linear 1 ed. São Paulo: Pioneira Thompson Learning

- ↑ Aberdeen, Stan. «Use of Linear Equations». Ehow. Consultado em 16 de janeiro de 2012

- ↑ «Calculadora online que soluciona sistemas de equações lineares»

- ↑ Giovanni, José Ruy; Bonjorno, José Roberto; Jr., José Ruy Giovanni (2002). «14». Matemática completa. São Paulo: FTD. p. 199. 592 páginas. ISBN 85-322-4827-6

- ↑ Introdução aos Métodos Numéricos [1]

- ↑ Hoffman, Kenneth; Kunze, Ray (1971). Álgebra Linear 1 ed. São Paulo: Polígono

- ↑ Domingues, Hygino H. «Origem dos Sistemas Lineares e Determinantes». Só Matemática. Consultado em 16 de janeiro de 2012

- ↑ Howard Anton; Robert C. Busby (2006). Algebra Linear Contemporânea. Bookman. p. 70. ISBN 978-85-7780-091-9.

- ↑ José A. Trigo Barbosa. Noções sobre Matrizes e Sistemas de Equações Lineares,2a edição. FEUP edições. p. 25. ISBN 978-972-752-137-1.

- ↑ Isabel Cabral; Cecília Perdigão; Carlos Saiago. Álgebra linear: teoria, exercícios resolvidos e exercícios propostos com soluções. Escolar Editora. p. 88. ISBN 978-972-592-239-2.

- ↑ «Sistemas Lineares». Consultado em 15 de março de 2021

- ↑ Métodos iterativos para sistemas lineares [2]

Ligações externas[editar | editar código-fonte]

- Álgebra Linear - Um Livro Colaborativo, mantido pelo Instituto de Matemática e Estatística da Universidade Federal do Rio Grande do Sul.

- Solução de sistemas linear em Cálculo Numérico - Um Livro Colaborativo, mantido pelo Instituto de Matemática e Estatística da Universidade Federal do Rio Grande do Sul

![{\displaystyle \left[{\begin{array}{ccc|c}a_{11}&a_{12}&a_{13}&b_{1}\\a_{21}&a_{22}&a_{23}&b_{2}\\a_{31}&a_{32}&a_{33}&b_{3}\end{array}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0cb216d97049a2cd3fa1a8f72f6926596d2ee8cb)

![{\displaystyle \left[{\begin{array}{ccc|c}a_{11}^{(1)}&a_{12}^{(1)}&a_{13}^{(1)}&b_{1}^{(1)}\\0&a_{22}^{(1)}&a_{23}^{(1)}&b_{2}^{(1)}\\0&a_{32}^{(1)}&a_{33}^{(1)}&b_{3}^{(1)}\end{array}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9f138f7f5a27ddb168c5ccca61023910c15e0d0f)

![{\displaystyle \left[{\begin{array}{ccc|c}a_{11}^{(2)}&a_{12}^{(2)}&a_{13}^{(2)}&b_{1}^{(2)}\\0&a_{22}^{(2)}&a_{23}^{(2)}&b_{2}^{(2)}\\0&0&a_{33}^{(2)}&b_{3}^{(2)}\end{array}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8844eb22458b7b6b9fc9c417e6439bd31cdfed4f)