Determinante

| Parte da série sobre | ||

| Matemática | ||

|---|---|---|

|

||

Em matemática, determinante é uma função matricial que associa a cada matriz quadrada um escalar, ou seja, é uma função que transforma uma matriz quadrada em um número real.[1] Esta função permite saber se a matriz tem ou não inversa, pois as que não têm são precisamente aquelas cujo determinante é igual a 0. O determinante de uma matriz é denotado por , ou .[Nota 1]

Para as matrizes de ordem 1, o valor do determinante é o próprio elemento: .

No caso de matrizes de ordem 2, multiplicam-se os elementos da diagonal principal e diminui-se do resultado a multiplicação dos elementos da diagonal secundária, ou seja:

Para matrizes de ordem 3, pode ser utilizada a Regra de Sarrus, a qual fornece:

De modo geral, para uma matriz de ordem , com , pode-se utilizar de dois outros processos, conhecidos como fórmula de Laplace e fórmula de Leibniz para determinantes.

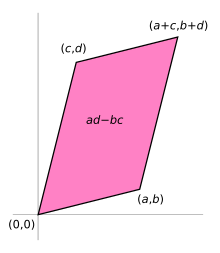

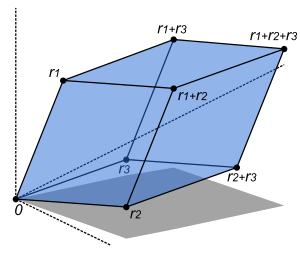

Geometricamente, o determinante pode ser visto como o fator de escala de volume da transformação linear descrita por uma matriz. Este também é o volume com sinal do paralelepípedo n-dimensional gerado pelos vetores coluna ou linha da matriz. O determinante é positivo ou negativo, dependendo de o mapeamento linear preservar ou reverter a orientação do espaço n-dimensional.

Determinantes aparecem em várias áreas da matemática. Por exemplo, uma matriz é frequentemente usada para representar os coeficientes em um sistema de equações lineares, e o determinante pode ser usado para resolver essas equações no caso de sistemas com o mesmo número de variáveis e de equações (se o determinante da matriz dos coeficientes for um valor diferente de zero, o sistema possui uma única solução; caso o valor do determinante seja zero, o sistema é possível indeterminado ou impossível[2]), embora outros métodos de solução sejam muito mais eficientes em termos computacionais.[3] Ainda na álgebra linear, uma matriz (com entradas em um corpo) é singular (não invertível) se, e somente se, seu determinante for zero. Isso leva ao uso de determinantes na definição do polinômio característico de uma matriz, cujas raízes são os autovalores. Os determinantes também utilizados para cálculos relacionados à independência linear e dão a orientação de uma base em um espaço vetorial.

Na geometria analítica, os determinantes expressam os volumes n-dimensionais com sinal dos paralelepípedos n-dimensionais. Isso leva ao uso de determinantes no cálculo, com o determinante da matriz jacobiana na regra de mudança de variáveis para integrais de funções de várias variáveis. Determinantes aparecem frequentemente em identidades algébricas, como a identidade de Vandermonde. Também aparecem no cálculos de circulantes.

Os determinantes possuem muitas propriedades algébricas. Uma delas é a multiplicatividade, a saber, que o determinante de um produto de matrizes é igual ao produto dos determinantes das matrizes. Tipos especiais de matrizes têm determinantes especiais; por exemplo, o determinante de uma matriz ortogonal é sempre , e o determinante de uma matriz hermitiana complexa é sempre real.[4]

Definição[editar | editar código-fonte]

Supondo que é uma matriz quadrada com linhas e colunas, ou seja,

o determinante de pode ser indicado por ou diretamente em termos das entradas da matriz, escrevendo-se barras em vez de colchetes:

Existem várias maneiras equivalentes de definir o determinante de . Talvez a maneira mais simples de definir o determinante seja de maneira recursiva considerando os elementos na primeira linha os respectivos menores[3]: começando pela esquerda, multiplica-se o primeiro elemento pelo menor, subtrai-se o produto do próximo elemento e seu menor e segue-se adicionando e subtraindo alternadamente esses produtos até que todos os elementos na linha estejam esgotados. Por exemplo, para o caso de uma matriz de ordem 4:

Assim, para o procedimento acima ser consistente, basta definir o determinante de uma matriz de ordem 1 como a própria entrada da matriz. Para uma matriz de ordem 3, tem-se

O procedimento acima é um caso particular da fórmula (ou teorema) de Laplace. O determinante de uma matriz de tamanho arbitrário também pode ser definido pela fórmula de Leibniz para determinantes.[4] A fórmula de Leibniz para o determinante de uma matriz de ordem é

onde a soma é computada sobre todas as permutações σ do conjunto . A permutação é uma função que reordena esse conjunto de inteiros. O valor da i-ésima posição depois da reordenação é denotado por . Por exemplo, para , a sequência original pode ser reordenada para , com , , . O conjunto de todas essas permutações é denotado por . Para cada permutação , denota o sinal de , que tem valor +1 sempre que a reordenação dada por puder ser alcançada através da troca sucessiva de duas entradas um número par de vezes, e valor -1 sempre que puder ser alcançada por um número ímpar dessas trocas.

Em qualquer um dos termos da soma,

é a notação para o produto das entradas nas posições , onde varia de para :

Por exemplo, para o determinante de uma matriz 3 × 3 (n = 3) tem-se:

História[editar | editar código-fonte]

Historicamente [nota 1], os determinantes eram usados muito antes das matrizes: originalmente, um determinante era definido como uma propriedade de um sistema de equações lineares. O determinante identifica se o sistema possui uma solução exclusiva (que ocorre precisamente se o determinante da matriz dos coeficientes for diferente de zero).[5]

Os determinantes foram usados pela primeira vez no livro de matemática chinês Os nove capítulos da arte matemática (estudiosos chineses, por volta do século III a.C.). Na Europa, os determinantes de matriz de ordem 2 foram estudados por Cardano no final do século XVI e os maiores por Leibniz.[6][7][8][9][10]

No Japão, Seki Takakazu é creditado pela descoberta do resultante e do determinante (inicialmente em 1683, mas a versão completa até 1710). Na Europa, Cramer (1750) acrescentou à teoria, relacionando o determinante a conjuntos de equações. A lei de recorrência foi anunciada pela primeira vez por Bézout (1764).[6]

Foi Vandermonde (1771) quem primeiro reconheceu os determinantes em relação a funções independentes. Laplace (1772) desenvolveu o método geral ao expandir um determinante em termos de seus menores complementares, onde Vandermonde já havia apresentado um caso especial. Imediatamente depois, Lagrange (1773) tratou determinantes de segunda e terceira ordem, provando muitos casos especiais de identidades gerais.[6]

Gauss (1801) fez o próximo avanço. Como Lagrange, ele usou muito os determinantes na teoria dos números. Ele introduziu a palavra determinante (Laplace usara resultante), embora não fosse com o significado atual. Gauss também chegou à noção de inverso do determinante e chegou muito perto do teorema da multiplicação.[6]

O próximo colaborador de importância é Binet (1811, 1812), que declarou formalmente o teorema relativo ao produto de duas matrizes de m colunas e n linhas, o que para o caso especial de m = n se reduz ao teorema da multiplicação. No mesmo dia (30 de novembro de 1812) em que Binet apresentou seu trabalho à Academia, Cauchy também apresentou um trabalho sobre o assunto (veja a fórmula de Cauchy-Binet). Neste, inicia-se a teoria em sua generalidade, com o uso da palavra determinante em seu sentido atual,[11] o resumo e a simplificação do que era então conhecido sobre o assunto, a melhora da notação e a apresentação de uma prova mais satisfatória que a realizada por Bineta para o teorema da multiplicação.[6]

A próxima figura importante foi Jacobi (de 1827). Ele usou o determinante funcional, o qual Sylvester mais tarde chamou de jacobiano e, em suas memórias no Crelle's Journal de 1841, tratou especialmente desse determinante funcional. Da mesma forma, tratou sobre a classe de funções alternadas, as quais Sylvester chamou de alternantes. Na época das últimas memórias de Jacobi, Sylvester (1839) e Cayley começaram seus trabalhos.[12]

O estudo de formas especiais de determinantes tem sido o resultado natural da complementação da teoria geral. Determinantes axissimétricos foram estudados por Lebesgue, Hesse e Sylvester; determinantes persimétricos por Sylvester e Hankel; circulantes por Catalan, Spottiswoode, Glaisher e Scott; determinantes de inclinação e Pfaffians, em conexão com a teoria da transformação ortogonal, por Cayley; continuantes por Sylvester; wronskianos (assim chamados por Muir) por Christoffel e Frobenius; determinantes compostos por Sylvester, Reiss e Picquet; jacobianos e hessianos por Sylvester; e determinantes simétricos por Trudi. Dos livros didáticos sobre o assunto, Spottiswoode foi o primeiro. Nos Estados Unidos, Hanus (1886), Weld (1893) e Muir/Metzler (1933) publicaram dissertações.[6]

Propriedades[editar | editar código-fonte]

- O determinante da matriz identidade é igual a :[13]

; - O determinante de uma matriz é igual ao determinante da sua transposta[3]:

; - Se uma matriz quadrada é invertível então, o determinante da sua inversa é o inverso do seu determinante[3]:

Resulta desta propriedade que para matrizes invertíveis o determinante não pode ser nulo; - O determinante do produto de matrizes quadradas de mesma ordem é o produto dos determinantes (teorema de Binet)[14]:

- O determinante da multiplicação de um escalar por uma matriz quadrada de ordem é igual a esse escalar, elevado a , vezes o determinante dessa matriz[3]:

onde é a ordem da matriz - Se é ortogonal, então ;[4]

- Se uma matriz é triangular (superior ou inferior) o seu determinante é o produto dos elementos da diagonal principal[3][4]:

Seja uma matriz triangular de ordem então ; - Se uma fila (linha ou coluna) da matriz é composta de zeros, então ;[3]

- Se cada elemento de uma linha (ou coluna) de for escrito como soma de duas parcelas; então é a soma de dois determinantes de ordem , cada um considerando como elemento daquela linha (ou coluna) uma das parcelas, sendo repetidas as demais linhas (ou colunas);[15]

- Se uma fila (linha ou coluna) de uma matriz é multiplicada por um escalar então o determinante da nova matriz é igual ao determinante de multiplicado por ;[3][4]

- Se duas linhas (ou colunas) de são permutadas, então o determinante da nova matriz é ;[3][4]

- Se tem duas linhas (ou colunas) iguais, então ;[2]

- Dadas as matrizes e quadradas, de ordem , com elementos diferentes apenas na fila . O determinante de , matriz quadrada de ordem , onde a sua fila é a soma dos elementos da filas de e de é igual ao determinante de somado ao determinante de ();[15]

- Se for somado, a uma linha (ou coluna) de , um múltiplo de outra linha (ou coluna), o determinante da nova matriz é igual ao de (essa propriedade também é conhecida como Teorema de Jacobi).[15]

Regra de Chiò[editar | editar código-fonte]

O teorema de Jacobi (propriedade 14 acima) ajuda na formulação da regra de Chiò, que permite reduzir em um a ordem da matriz e facilitar o cálculo do determinante.[15] A regra consiste em suprimir a primeira linha e a primeira coluna de uma matriz , cujo elemento é igual a e, para cada elemento restante, subtrair o produto dos elementos nas extremidades das linha e coluna suprimidas, ou seja, substituir por: . A nova matriz possui o mesmo determinante que a anterior:

No caso de a matriz não ter , pode-se utilizar as propriedades 10, 11 ou 14 para se obter uma nova matriz cujo elemento da primeira linha e da primeira coluna é .

Complemento de Schur[editar | editar código-fonte]

A identidade a seguir vale para um complemento Schur de uma matriz quadrada.[16] O complemento de Schur surge como resultado da eliminação gaussiana em blocos, ao se multiplicar uma matriz , pela direita, por uma matriz triangular inferior em bloco

Aqui indica a matriz identidade . Após multiplicação com a matriz , o complemento de Schur aparece no bloco superior . A matriz produto é

Ou seja, foi efetuada uma decomposição gaussiana

de modo que, como a primeira e a terceira matrizes que aparecem no lado direito da igualdade têm determinante igual a 1,

Essa é a fórmula do determinante de Schur.

Teorema do determinante de Sylvester[editar | editar código-fonte]

Sylvester's determinant theorem states that for A, an m × n matrix, and B, an n × m matrix (so that A and B have dimensions allowing them to be multiplied in either order forming a square matrix):O teorema do determinante de Sylvester afirma que para uma matriz , , e uma uma matriz , , (de modo que e tenham dimensões que permitam que sejam multiplicadas em qualquer ordem, formando uma matriz quadrada):

onde e são as matrizes identidade de ordens e , respectivamente. A partir deste resultado geral, seguem várias consequências:

- Para o caso de um vetor coluna e de vetor de linha , cada um com componentes, a fórmula permite o cálculo rápido do determinante de uma matriz que difere da matriz de identidade por uma matriz de posto 1:

- De modo mais geral,[17] para qualquer matriz invertível , de ordem :

- Para vetores coluna e linha, como os acima:

- Para matrizes quadradas A e B do mesmo tamanho, as matrizes AB e BA têm os mesmos polinômios característicos e, portanto, os mesmos autovalores.

Cálculo de determinantes[editar | editar código-fonte]

Determinante de uma matriz de ordem 1[editar | editar código-fonte]

O determinante da matriz de ordem é o própria entrada da matriz, ou seja, para uma matriz quadrada , tem-se . Por exemplo, para

Determinante de uma matriz de ordem 2[editar | editar código-fonte]

O determinante de uma matriz de ordem 2 é a diferença entre o produto dos termos da diagonal principal e o produto dos termos da diagonal secundária:

Por exemplo, o determinante da matriz é dado por:

Determinante de uma matriz de ordem 3[editar | editar código-fonte]

Para calcular o determinante de matrizes de ordem 3, geralmente é utilizada a regra de Sarrus. O determinante é dado por

inicialmente são copiadas as duas primeiras colunas da matriz à direita da terceira coluna, de modo que seja obtida uma sequência de cinco colunas

Determinantes de matrizes de ordem maior que 3[editar | editar código-fonte]

Para o cálculo de determinantes de matrizes quadradas de ordem superior ou igual a 2 pode ser utilizado o teorema de Laplace. Esse teorema estabelece o seguinte:

- O determinante de uma matriz é igual à soma dos produtos dos elementos de qualquer linha ou coluna pelos respectivos complementos algébricos(cofatores matriciais).[18]

O complemento algébrico de um elemento de uma matriz é o número sendo o determinante da matriz que se obtém eliminando da matriz original a linha e a coluna .

Na prática, o uso do teorema de Laplace equivale a reduzir o cálculo do determinante de uma matriz de ordem ao cálculo de determinantes de matrizes de ordem , podendo ser aplicado quantas vezes forem necessárias até serem obtidos determinantes mais fáceis de se calcular (de matrizes de ordem 2 ou 3). Fixando-se a linha , o teorema pode ser expresso pela fórmula:

ou, fixando-se a coluna :

- ,

onde é a ordem da matriz. A escolha da linha ou coluna da matriz para a aplicação do processo é indiferente; contudo, para maior simplicidade dos cálculos, convém escolher a linha ou coluna que contiver mais zeros.

Outra alternativa para o cálculo de determinantes de matrizes de qualquer ordem é a fórmula de Leibniz para determinantes. No entanto, assim como a aplicação do teorema de Laplace, essa opção é inviável para se trabalhar com matrizes de grande porte, sendo preferível, especialmente do ponto de vista computacional, o processo de triangularização de matrizes (eliminação gaussiana).

Exemplo: aplicação do teorema de Laplace a uma matriz 4x4[editar | editar código-fonte]

Considerando a matriz

e desenvolvendo o determinante pela primeira linha, obtém-se:

- ,

ou seja, é necessário o cálculo de quatro determinantes de matrizes de ordem 3 (a não ser que algum dos termos da primeira linha de seja zero):

- .

Cálculo de determinantes por triangularização de matrizes[editar | editar código-fonte]

Uma forma mais simples de calcular o determinante de matrizes de grande porte é fazer o uso de algumas propriedades, de modo a reescrever uma matriz de modo que o determinante possa, em seguida, ser calculado imediatamente.[3] Tendo em vista a propriedade 5, que afirma que o determinante de uma matriz triangular é igual ao seu termo principal (produto dos elementos da diagonal principal), a ideia é aplicar outras propriedades nas linhas (ou colunas) da matriz, de modo a triangularizá-la (transformá-la em uma matriz triangular). Este processo é conhecido como triangularização de matrizes, sendo equivalente ao processo de eliminação gaussiana. Para tal, observam-se as seguintes propriedades, conhecidas como operações elementares sobre as linhas de uma matriz,[3] as quais podem ou não alterar o determinante:

- Permutar linhas troca o sinal do determinante (propriedade 11);

- Multiplicar uma linha por um número real não nulo, multiplica o determinante por (propriedade 10);

- Somar a uma linha um múltiplo de outra linha não altera o determinante (propriedade 14).

Para triangularizar a matriz basta atentar para as possíveis compensações, no determinante, provocadas pelas operações elementares utilizadas, não havendo uma única maneira de realizar esse processo. O método é algorítmico, constituído da seguinte ideia: a cada coluna, da primeira à penúltima, deve-se obter zeros nas posições abaixo da diagonal principal. Veja o exemplo a seguir:

Exemplos[editar | editar código-fonte]

- Nota-se que[19]

- ,

onde foram feitas, respectivamente, as seguintes operações elementares nas linhas:

- O determinante da matriz

pode ser calculado a partir das seguintes matrizes:

Aqui, é obtida a partir de pela adição de −1/2 vezes a primeira linha na segunda linha, de modo que . A matriz é obtida a partir de pela adição da terceira linha à primeira, de modo que . Finalmente, a matriz é obtida a partir de pela permuta entre as linhas 2 e 3, de modo que . Como é uma matriz triangular superior, o seu determinante é igual ao termo principal: . Portanto, .

Determinantes e autovalores[editar | editar código-fonte]

Se é uma matriz, de ordem , cujas entradas são números complexos e cujos autovalores são , então o determinante de é o produto dos autovalores[4]:

O produto de todos os autovalores diferentes de zero é chamado de pseudo-determinante.

Por outro lado, os determinantes podem ser usados para encontrar os autovalores da matriz [3]: são as soluções da equação característica

onde é a matriz de identidade da mesmo tamanho que e é um número (escalar) que resolve a equação (não existem mais que soluções, onde é o tamanho de ).

Uma matriz hermitiana é positiva definida se todos os seus autovalores forem positivos. O critério de Sylvester afirma que isso é equivalente ao fato dos determinantes das submatrizes

serem positivos para todo entre and .[20]

O traço é, por definição, a soma das entradas da diagonal de . Ele também é igual à soma dos autovalores de .[4]

Aplicações[editar | editar código-fonte]

Independência Linear[editar | editar código-fonte]

O determinante[nota 2] de uma matriz (com entradas reais ou complexas, por exemplo) é zero se e somente se os vetores de coluna (ou os vetores de linha) da matriz forem linearmente dependentes. Assim, determinantes podem ser usados para caracterizar vetores linearmente dependentes. Por exemplo, dados dois vetores linearmente independentes em , um terceiro vetor está no plano gerado pelos dois primeiros vetores se o determinante da matriz de ordem 3 que consiste nos três vetores for zero.

A mesma ideia também é usada na teoria das equações diferenciais: dadas funções (supostamente vezes diferenciáveis), o Wronskiano é definido como

Ele é diferente de zero (para algum ), em um intervalo especificado, se e somente se as funções fornecidas e todas as suas derivadas até a ordem forem linearmente independentes. Se for demonstrado que o Wronskiano é zero para todo ponto de um intervalo, no caso de funções analíticas, isso implica que as funções fornecidas são linearmente dependentes.[21]

Orientação de uma base[editar | editar código-fonte]

O determinante pode atribuir um número a cada sequência de vetores em , usando a matriz quadrada cujas colunas (ou linhas) são os vetores. Por exemplo, uma matriz ortogonal com entradas em representa uma base ortonormal no espaço euclidiano. O determinante dessa matriz determina se a orientação da base é consistente ou oposta à orientação da base canônica. Se o determinante for +1, a base tem a mesma orientação. Se for -1, a base tem a orientação oposta.

De modo geral, se o determinante de uma matriz A é positivo, A representa uma transformação linear que preserva a orientação (se A é uma matriz ortogonal 2 × 2 ou 3 × 3, representa uma rotação), enquanto que se for negativo, A altera a orientação da base.

Volume e determinante jacobiano[editar | editar código-fonte]

O valor absoluto do determinante de vetores reais é igual ao volume do paralelepípedo gerado por esses vetores. Como consequência, se é o mapeamento linear representado pela matriz e é qualquer subconjunto mensurável de , o volume de é dado por vezes o volume de . Em geral, se o mapeamento linear é representado pela matriz , de ordem , então o volume -dimensional de é dado por:

Ao calcular o volume do tetraedro delimitado por quatro pontos, eles podem ser usados para identificar linhas de inclinação. O volume de qualquer tetraedro, dados seus vértices e é .

Para uma função diferenciável geral, grande parte do exposto acima se mantém ao se considerar a matriz jacobiana de . Para

a matriz jacobiana é a matriz de ordem cujas entradas são dadas por

Seu determinante, o jacobiano, aparece na versão de dimensão mais alta da integração por substituição: para funções convenientes e um subconjunto aberto de (o domínio de ), a integral sobre de alguma outra função é dada por

O jacobiano também aparece no teorema da função inversa.

Determinante de Vandermonde (alternante)[editar | editar código-fonte]

O determinante de ordem 3 da matriz de Vandermonde é

Em geral, o determinante de Vandermonde de ordem é[22]

onde o lado direito é o produto continuado de todas as diferenças que podem ser formadas a partir dos pares de números retirados de , com a ordem das diferenças encontradas na ordem invertida dos sufixos envolvidos.

Circulantes[editar | editar código-fonte]

Segunda ordem

Terceira ordem

onde e são as raízes cúbicas complexas de 1. Em geral, o determinante circulante de ordem é[22]

onde é a n-ésima raiz de 1.

Ver também[editar | editar código-fonte]

Notas e referências

Notas

- ↑ Srção retirada e traduzida da wikipédia inglesa (página Determinant)

- ↑ Retirado e traduzido da wikipédia inglesa na página Determinant

- ↑ A notação foi introduzida pela primeira vez por volta de 1841 pelo matemático inglês Arthur Cayley (MacTutor).

Referências

- ↑ Carlos Alberto Campagner. «Determinante». UOL - Educação. Consultado em 28 de junho de 2013

- ↑ a b PAIVA, Manoel Todrigues (2010). Matemática: Paiva, 2. São Paulo: Moderna. ISBN 9788516068332

- ↑ a b c d e f g h i j k l LAY, David C (2013). Álgebra linear e suas aplicações. Rio de Janeiro: LTC

- ↑ a b c d e f g h FRANKLIN, Joel N. (2012). Matrix theory. [S.l.]: Courier Corporation

- ↑ A Brief History of Linear Algebra and Matrix Theory : «Archived copy». Consultado em 24 de janeiro de 2012. Arquivado do original em 10 de setembro de 2012

- ↑ a b c d e f History of matrices and determinants: http://www-history.mcs.st-and.ac.uk/history/HistTopics/Matrices_and_determinants.html

- ↑ Campbell, H: "Linear Algebra With Applications", pages 111–112. Appleton Century Crofts, 1971

- ↑ Eves, H: "An Introduction to the History of Mathematics", pages 405, 493–494, Saunders College Publishing, 1990.

- ↑ A Brief History of Linear Algebra and Matrix Theory : «Archived copy». Consultado em 24 de janeiro de 2012. Arquivado do original em 10 de setembro de 2012

- ↑ Cajori, F. A History of Mathematics p. 80

- ↑ Origins of mathematical terms: http://jeff560.tripod.com/d.html

- ↑ History of matrix notation: http://jeff560.tripod.com/matrices.html

- ↑ Callioli 1990, p. 205

- ↑ Callioli 1990, p. 219

- ↑ a b c d IEZZI, Gelson (1977). Fundamentos de matemática elementar, 4: sequências, progressões, determinantes e sistemas lineares. São Paulo: Atual. ISBN 9788535717488

- ↑ ZHANG, Fuzhen (Ed.) (2006). The Schur complement and its applications. [S.l.]: Springer Science & Business Media

- ↑ http://www.ee.ic.ac.uk/hp/staff/dmb/matrix/proof003.html

- ↑ Teorema de Laplace

- ↑ «Outros exemplos e métodos». REAMAT, Recursos Educacionais Abertos de Matemática. Instituto de Matemática e Estatística da Universidade Federal do Rio Grande do Sul. Consultado em 18 de julho de 2018

- ↑ «Sylvester's Criterion». Consultado em 23 de março de 2020

- ↑ BOYCE, William E.; DIPRIMA, Richard C. (2012). Equações diferenciais elementares e problemas de valores de contorno. Rio de Janeiro: LTC

- ↑ a b Gradshteyn, Izrail Solomonovich; Ryzhik, Iosif Moiseevich; Geronimus, Yuri Veniaminovich; Tseytlin, Michail Yulyevich (fevereiro de 2007). «14.31». In: Jeffrey, Alan; Zwillinger, Daniel. Table of Integrals, Series, and Products (em inglês). Traduzido por Scripta Technica, Inc. 7 ed. [S.l.]: Academic Press, Inc. ISBN 978-0-12-373637-6. LCCN 2010481177. MR 2360010

Bibliografia[editar | editar código-fonte]

- Callioli, Carlos A.; Hygino H. Domingues; Roberto C. F. Costa (1990). Álgebra Linear e Aplicações 6 ed. São Paulo: Atual. ISBN 9788570562975

![{\displaystyle \sigma =[2,3,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/9685f1eb19aaa6e18aa6baa5159706b35f2edc9f)

![{\displaystyle {\begin{aligned}\sum _{\sigma \in S_{n}}\operatorname {sgn}(\sigma )\prod _{i=1}^{n}a_{i,\sigma _{i}}&={}\operatorname {sgn}([1,2,3])\prod _{i=1}^{n}a_{i,[1,2,3]_{i}}+\operatorname {sgn}([1,3,2])\prod _{i=1}^{n}a_{i,[1,3,2]_{i}}+\operatorname {sgn}([2,1,3])\prod _{i=1}^{n}a_{i,[2,1,3]_{i}}\\&+{}\operatorname {sgn}([2,3,1])\prod _{i=1}^{n}a_{i,[2,3,1]_{i}}+\operatorname {sgn}([3,1,2])\prod _{i=1}^{n}a_{i,[3,1,2]_{i}}+\operatorname {sgn}([3,2,1])\prod _{i=1}^{n}a_{i,[3,2,1]_{i}}\\&={}\prod _{i=1}^{n}a_{i,[1,2,3]_{i}}-\prod _{i=1}^{n}a_{i,[1,3,2]_{i}}-\prod _{i=1}^{n}a_{i,[2,1,3]_{i}}+\prod _{i=1}^{n}a_{i,[2,3,1]_{i}}+\prod _{i=1}^{n}a_{i,[3,1,2]_{i}}-\prod _{i=1}^{n}a_{i,[3,2,1]_{i}}\\[2pt]&={}a_{1,1}a_{2,2}a_{3,3}-a_{1,1}a_{2,3}a_{3,2}-a_{1,2}a_{2,1}a_{3,3}+a_{1,2}a_{2,3}a_{3,1}+a_{1,3}a_{2,1}a_{3,2}-a_{1,3}a_{2,2}a_{3,1}.\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b2fdec1f027c648f95b8587ee3e46a94ccea05fd)

![{\displaystyle L=\left[{\begin{matrix}I_{p}&0\\-D^{-1}C&I_{q}\end{matrix}}\right].}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8d2de9f5f13686b885f8c4ebd9db596b6804fd5e)

![{\displaystyle {\begin{aligned}ML&=\left[{\begin{matrix}A&B\\C&D\end{matrix}}\right]\left[{\begin{matrix}I_{p}&0\\-D^{-1}C&I_{q}\end{matrix}}\right]=\left[{\begin{matrix}A-BD^{-1}C&B\\0&D\end{matrix}}\right]=\left[{\begin{matrix}I_{p}&BD^{-1}\\0&I_{q}\end{matrix}}\right]\left[{\begin{matrix}A-BD^{-1}C&0\\0&D\end{matrix}}\right].\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c40f23e6893228b235acb7fcfb15f93faea0cee7)

![{\displaystyle \left[{\begin{matrix}A&B\\C&D\end{matrix}}\right]=\left[{\begin{matrix}I_{p}&BD^{-1}\\0&I_{q}\end{matrix}}\right]\left[{\begin{matrix}A-BD^{-1}C&0\\0&D\end{matrix}}\right]\left[{\begin{matrix}I_{p}&0\\D^{-1}C&I_{q}\end{matrix}}\right],}](https://wikimedia.org/api/rest_v1/media/math/render/svg/457fd6c381484606e40199291bc571aa5c10be14)

![{\displaystyle A=[a_{11}]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/49387875728d921dde40ed24c7cde1f46cf34f92)