Variável aleatória

| Teoria das probabilidades |

|---|

|

Uma variável aleatória é uma variável quantitativa, cujo resultado (valor) depende de fatores aleatórios. Um exemplo de uma variável aleatória é o resultado do lançamento de um dado que pode dar qualquer número entre 1 e 6. Embora possamos conhecer os seus possíveis resultados, o resultado em si depende de fatores de sorte (álea). Uma variável aleatória é uma medição que gera valores não-antecipados. O conceito de variável aleatória é essencial em estatística e em outros métodos quantitativos para a representação de fenômenos incertos.[1]

As variáveis aleatórias podem ser classificadas em variáveis aleatórias discretas, contínuas e mistas.

Um exemplo de uma variável aleatória é a altura de uma pessoa, em que o conjunto de pessoas é e a variável aleatória é a função que mapeia a pessoa a sua altura . Com a lei da probabilidade associada a é possível calcular a probabilidade de a altura ser em qualquer subconjunto de valores entre 180 centímetros e 190 centímetros ou a probabilidade de a altura ser menos que 150 centímetros ou mais que 200 centímetros .[2]

Definição informal[editar | editar código-fonte]

Em matemática, uma variável aleatória pode ser definida como uma função que associa a todo evento pertencente a uma partição do espaço amostral um único número real, isto é, .[3] É comum a representação das variáveis aleatórias por letras maiúsculas e dos valores assumidos por letras minúsculas (ver ilustração).[4]

Entre as definições informais frequentemente utilizadas para as variáveis aleatórias estão:

- Uma variável aleatória é uma variável que pode assumir diferentes valores numéricos, definidos para um evento de um espaço amostral .

- Uma variável aleatória pode ser entendida como o resultado numérico de operar um mecanismo não determinístico ou de fazer uma experiência não determinística para gerar resultados aleatórios.

- Uma variável aleatória tem resultados que tendem a variar entre as observações devido a fatores relacionados a chance.

Um exemplo de uma variável aleatória é a altura de uma pessoa, em que o conjunto de pessoas é e a variável aleatória é a função que mapeia a pessoa a sua altura . Com a lei da probabilidade associada a é possível calcular a probabilidade de a altura ser em qualquer subconjunto de valores entre 180 centímetros e 190 centímetros ou a probabilidade de a altura ser menos que 150 centímetros ou mais que 200 centímetros .[2]

Outro exemplo de uma variável aleatória é o lançamento de um dado, em que sendo o resultado de lançamentos do dado. Todas as probabilidades de diferentes resultados são dadas pela medida de probabilidade . Seja o resultado do lançamento do dado, . Então, a probabilidade de ser menor ou igual a 3 é a medida do conjunto de resultados , denotado como [5]

Extensões[editar | editar código-fonte]

Quando não é necessariamente uma função real , em que é qualquer espaço (espaço mensurável), costuma-se chamar a variável de elemento aleatório. O termo variável aleatória é tradicionalmente limitado ao caso real , o que assegura que é possível definir quantidades como o valor esperado e a variância de uma variável aleatória, sua função de distribuição acumulada e os momentos de sua distribuição.[5]

Entretanto, a definição é válida para qualquer espaço mensurável . Então, é possível considerar elementos aleatórios de outros conjuntos como valores booleanos aleatórios, variáveis categóricas, números complexos, vetores, matrizes, sequências, árvores, conjuntos, formas, variedades e funções. Portanto, é possível referir-se a uma variável aleatória do tipo .[6]

O conceito mais geral de elemento aleatório é particularmente útil em disciplinas como teoria dos grafos, aprendizado de máquina, processamento de linguagem natural e outras áreas da matemática discreta ou da ciência da computação, nas quais há geralmente o interesse de modelar variação aleatória de estrutura de dados não numéricos. Porém, em alguns casos é conveniente representar cada elemento de usando um ou mais números reais.[7] O elemento aleatório pode opcionalmente ser representado como um vetor de variáveis aleatórias reais (definidas no mesmo espaço de probabilidade , que permite que variáveis aleatórias diferentes co-variem). Por exemplo:

- Uma palavra aleatória pode ser representada como um número inteiro aleatório que serve como um índice no vocabulário de palavras possíveis. Ela também pode ser representada como um vetor aleatório cujo comprimento é igual ao tamanho do vocabulário, em que os únicos valores de probabilidade positiva são , , e a posição do número 1 indica a palavra.

- Uma sentença aleatória de um dado comprimento pode ser representada com um vetor de palavras aleatórias.

- Um grafo aleatório em dados vértices pode ser representado como uma matriz X de variáveis aleatórias, cujos valores especificam a matriz de adjacência do grafo aleatório.

- Uma função aleatória pode ser representada como uma coleção de variáveis aleatórias , dados os valores das funções nos vários pontos no domínio da função. são variáveis aleatórias reais desde que a função seja uma função real. Por exemplo, o processo estocástico é uma função aleatória de tempo, um vetor aleatório é uma função aleatória de algum conjunto de índices como e campo aleatório é uma função aleatória em qualquer conjunto (tipicamente, tempo, espaço ou conjunto discreto).[6]

Exemplo[editar | editar código-fonte]

Uma variável aleatória também pode ser uma função da variável aleatória original (transformação da variável aleatória original). Isto é, uma função da função ou uma função composta.[8] No espaço amostral do lançamento simultâneo de duas moedas, há = {(cara, cara), (cara, coroa), (coroa, cara), (coroa, coroa)}. É possível definir a variável aleatória como o número de caras, a variável aleatória como o número de caras multiplicado por três mais o número de coroas multiplicado por dois e a variável aleatória como o número de caras multiplicado por 2 .[9]

| Ponto amostral | Variável aleatória

= número de caras |

Variável aleatória

|

Variável aleatória

|

|---|---|---|---|

| (cara, cara) | (cara, cara) = 2 | Y(cara, cara) = 4 + 2 = 6 | Z((cara, cara)) = 2 x 2 = 4 |

| (cara, coroa) | (cara, coroa) = 1 | Y(cara, coroa) = 4 + 1 = 5 | Z((cara, coroa)) = 2 x 1 = 2 |

| (coroa, cara) | (coroa, cara) = 1 | Y(coroa, cara) = 4 + 1 = 5 | Z((coroa, cara)) = 2 x 1 = 2 |

| (coroa, coroa) | (coroa, coroa) = 0 | Y(coroa, coroa) = 4 + 0 = 4 | Z((coroa, coroa)) = 2 x 0 = 0 |

Caso padrão[editar | editar código-fonte]

Quando a imagem (variação) de é finita ou infinita contável, a variável aleatória é chamada de variável aleatória discreta e sua distribuição pode ser descrita por uma função massa de probabilidade que atribui uma probabilidade a cada valor na imagem de . Quando a imagem de é infinita contável, a variável aleatória é chamada de variável aleatória contínua e sua distribuição pode ser descrita por uma função densidade de probabilidade que atribui probabilidades aos intervalos.[10]

Em particular, cada ponto individual precisa ter necessariamente probabilidade zero para uma variável aleatória absolutamente contínua. Nem todas as variáveis aleatórias são absolutamente contínuas. Por exemplo, uma distribuição mista. Tais variáveis aleatórias não podem ser descritas por uma função densidade ou por uma função massa de probabilidade. Qualquer variável aleatória pode ser descrita por uma função de distribuição acumulada, que descreve a probabilidade que a variável aleatória ser menor ou igual a um certo valor.[11]

Definição formal[editar | editar código-fonte]

Em termos mais abstratos, uma variável aleatória é uma função que mapeia um resultado de um evento (em um ponto em um espaço de probabilidade) a um resultado matematicamente conveniente, geralmente um número real. É a atribuição de um número a um resultado, um procedimento que paradoxalmente não é nem aleatório nem variável. Uma função que caracteriza uma variável aleatória sempre deve ser mensurável, o que exclui certos casos em que as variáveis aleatórias são infinitamente sensíveis a qualquer pequena alteração no resultado.[5] Então, formalmente uma variável aleatória é uma função mensurável de um espaço de probabilidade, cujo contradomínio é o corpo dos números reais.[12]

A variável aleatória é a função mensurável de um conjunto de resultados possíveis para um conjunto . A definição axiomática requer que seja um espaço mensurável . Isto é, é considerado junto com um sistema de subconjuntos de chamado σ-álgebra. Os elementos de são chamados conjuntos mensuráveis. É possível observar que em geral não é qualquer subconjunto de que é mensurável (ou seja, que pertence a ). A definição axiomática também requer que seja um espaço mensurável, em que a σ-álgebra de Borel é comumente usada como a σ-álgebra de subconjuntos de .[12][13]

| Em linguagem matemática | Em português |

|---|---|

| .[13][14] | A função de em será uma variável aleatória (ou uma função mensurável) se e somente se, para todo valor , o conjunto de elementos , tais que o valor de função nos elementos seja menor ou igual a , pertencer ao σ-álgebra .[13][14] |

Funções de distribuição de variáveis aleatórias[editar | editar código-fonte]

Dada uma variável aleatória definida em um espaço de probabilidade , é possível fazer perguntas como o quão provável o valor de é igual a 2? É a mesma probabilidade do evento , que muitas vezes é escrita como ou . Tomando todas essas probabilidades de intervalos de resultados de uma variável aleatória real resulta na distribuição de probabilidade de . A distribuição de probabilidade não considera o espaço de probabilidade particular usado para definir e apenas considera a probabilidade de vários valores de . Tal distribuição de probabilidade sempre pode ser capturada por sua função de distribuição acumulada, às vezes usando a função densidade de probabilidade .[15]

Em termos da teoria da medida, a variável aleatória empurra a medida em para a medida em . O espaço de probabilidade subjacente é um mecanismo técnico usado para garantir a existência de variáveis aleatórias, às vezes para construi-las e para definir noções como correlação e dependência ou independência com base em uma distribuição conjunta de duas ou mais variáveis aleatórias no mesmo espaço de probabilidade. Na prática, muitas vezes descarta-se completamente o espaço e põe-se apenas a medida em que atribui medida 1 para toda a linha real. Isto é, trabalha-se com distribuições de probabilidade em vez de variáveis aleatórias.[15]

Classificação das variáveis aleatórias[editar | editar código-fonte]

As variáveis aleatórias podem ser discretas, contínuas ou mistas.[16]

| Discretas | Contínuas | Mistas |

|---|---|---|

| Uma função , definida no espaço amostral e assumindo valores em um conjunto enumerável de pontos da reta, é dita uma variável aleatória discreta.[16] | Uma função , definida no espaço amostral e assumindo valores em um intervalo de números reais, é dita uma variável aleatória contínua.[17] | Uma função , cujo contradomínio x é não numerável, mas que contém um subconjunto (finito ou infinito numerável), em que cada um dos pontos tem probabilidade maior que zero é dita uma variável aleatória mista.[18] |

Variável aleatória discreta[editar | editar código-fonte]

Uma variável aleatória discreta pode assumir valores que podem ser contados. Isto é, uma variável aleatória discreta é uma variável para a qual o conjunto é um conjunto finito ou infinito contável. Por exemplo, ou . É uma variável aleatória que assume valores finitos ou infinitos contáveis (a soma de muitos números positivos reais incontáveis sempre converge para o infinito).[16]

O lançamento de um dado de seis lados é um exemplo de variável aleatória discreta finita. O dado fornece um valor inteiro em todos os lançamentos, de modo que não existe a possibilidade de ele cair de lado e fornecer um valor fracionário como 2,5555.[19]

Já o número de carros que passam por um pedágio é um exemplo de variável aleatória discreta infinita. Passará uma infinidade de carros, porém nunca passará a metade de um carro por um pedágio (não haverá frações no número de carros que passarão por um pedágio). O resultado não é conhecido a princípio, mas é sempre descritível com facilidade.[19]

Entre outros exemplos de variáveis aleatórias discretas, estão o número de acidentes em uma semana, o número de caras em cinco lançamento de moeda, o número de defeitos em sapatos, o número de falhas em uma safra, o número de terremotos, o número de jogos empatados e o número de livros em uma estante. Entre as distribuições de probabilidade discretas mais conhecidas também estão distribuição de Bernoulli, distribuição binomial, distribuição binomial negativa, distribuição geométrica, distribuição hipergeométrica, distribuição de Poisson e distribuição uniforme.[17]

Lançamento de uma moeda[editar | editar código-fonte]

Uma variável aleatória discreta pode ser usada para descrever os possíveis resultados do lançamento de uma moeda. Os possíveis resultados para um lançamento de uma moeda podem ser descritos pelo espaço amostral . É possível introduzir a variável aleatória real , que corresponde a recompensa de 1 dólar para uma aposta bem sucedida em cara:

Se for uma moeda justa, tem uma função massa de probabilidade dada por:

Lançamento de dois dados[editar | editar código-fonte]

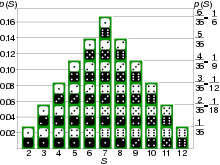

Uma variável aleatória discreta também pode ser usada para descrever os possíveis resultados do lançamento de dois dados. Uma representação óbvia do lançamento de dois dados é assumir o conjunto de números pares de {1, 2, 3, 4, 5, 6} como o espaço amostral e o número total de lançamentos (a soma dos números de cada conjunto) como a variável aleatória dada pela função que mapeia o conjunto a soma e tem a função massa de probabilidade dada por.[2]

Variável aleatória contínua[editar | editar código-fonte]

Uma variável aleatória contínua pode assumir qualquer valor numérico em um determinado intervalo ou série de intervalos. Isto é, uma variável aleatória contínua é uma variável para a qual o conjunto A é um conjunto infinito não enumerável. É uma variável que assume valores dentro de intervalos de números reais.[17]

O resultado de lançamento de martelo nas Olimpíadas é um exemplo de variável aleatória contínua. Sabe-se que os valores do lançamento de martelo atingem a distância máxima de 60 metros e a distância mínima classificatória de 30 metros. Todos os lançamentos poderão assumir uma infinidade de possibilidades dentro no intervalo entre 60 metros e 30 metros, pois sempre existirá uma fração para medir a menor diferença possível entre os lançamentos como 59 metros, 25 centímetros, 12 milímetros e assim por diante. Então, seria uma variável aleatória contínua que assumiria qualquer valor no intervalo 30 60.[20]

Entre outros exemplos de variáveis aleatórias contínuas, estão valores de corrente elétrica em um cabo elétrica, flutuações de temperatura, pesos de caixas de laranja, medidas de uma peça usada na indústria para fins de controle de qualidade, alturas de pinheiros, duração de uma conversa telefônica e tempo necessário para completar um ensaio.[20]

Relógio[editar | editar código-fonte]

Seja um relógio mecânico. O ponteiro dos segundos de um relógio mecânico pode parar devido a um defeito técnico. Seja o ângulo que o ponteiro dos segundos forma com o ponteiro dos minutos, quando o ponteiro dos minutos aponta para o número 12. Como o ponteiro dos segundos move-se 60 vezes, é uma variável aleatória discreta. Seja agora um relógio digital. O ponteiro dos segundos de um relógio digital também pode parar devido a um defeito técnico. Como o ponteiro dos segundos move-se continuadamente ele pode parar em qualquer ponto, por isso é preciso de outro modelo para representar a variável aleatória .[17]

Em primeiro lugar, o conjunto dos possíveis valores de não é mais um conjunto discreto de valores. pode assumir qualquer valor do intervalo . Em segundo lugar, existem infinitos pontos nos quais o ponteiro dos segundos pode parar. Usando o mesmo método da variável aleatória discreta, cada ponto teria probabilidade igual a zero. Por um lado, não seria possível determinar a probabilidade de o ângulo se igual a certo valor porque a probabilidade seria igual a zero. Por outro lado, seria possível determinar a probabilidade de estar compreendido entre dois valores quaisquer. Por exemplo, a probabilidade de o ponteiro dos segundos parar no intervalo entre os números 12 e 3 é porque corresponde a do intervalo total e a probabilidade de o ponteiro dos segundos parar no intervalo entre os números 4 e 5 é porque corresponde a do intervalo total. Isto é, e .[17]

Sempre será possível calcular a probabilidade de o ponteiro parar em um ponto qualquer do intervalo (por menor que ele seja), de acordo com a seguinte função:

Variável aleatória mista[editar | editar código-fonte]

Existem situações práticas, em que a variável aleatória pode tanto assumir valores discretos quando assumir todos os valores em um determinado intervalo. Essas variáveis aleatórias são conhecidas como variáveis aleatórias mistas.[18]

Lançamento de moeda com jogo de roleta[editar | editar código-fonte]

Um exemplo de uma variável aleatória mista pode ser um experimento em que uma moeda é lançada e uma roleta é girada se o resultado do lançamento da moeda for cara. Se o resultado do lançamento da moeda for cara, é igual ao valor da roleta. Se o resultado do lançamento da moeda for coroa, é igual a -1. Há a probabilidade meio de essa variável aleatória ter o valor -1, e meio de ficar no intervalo .[21]

Funções associadas às variáveis aleatórias[editar | editar código-fonte]

Uma variável aleatória é uma função que está intimamente relacionada com três outras funções, função densidade, função de probabilidade e função distribuição acumulada. Uma variável aleatória também está intimamente relacionada com a distribuição de probabilidade, que corresponde a probabilidade de uma variável aleatória assumir um determinado valor do domínio. Por exemplo, a probabilidade de o resultado do lançamento de um dado honesto ser 3. Uma variável aleatória pode ser univariada ou multivariada. Há a transformação da função densidade para função conjunta quando a variável aleatória é multivariada. Há também a mudança de nome da função probabilidade, dependendo do tipo da variável aleatória.[13]

| Variável Aleatória | Univariada

(unidimensional) |

Multivariada

(vetor aleatório) |

|---|---|---|

| Discreta | Função de probabilidade | Função de distribuição conjunta |

| Contínua | Função densidade de probabilidade | Função densidade de probabilidade conjunta |

Funções de variáveis aleatórias[editar | editar código-fonte]

Em um experimento, um indivíduo pode se interessar mais pela função do resultado e menos pelo resultado em si. Em um lançamento de dados, um apostador pode se interessar mais na soma dos resultados e menos nos valores individuais (isto é, ele pode priorizar uma soma de resultado 10 em vez de uma sequência real de 5, 5 ou 6, 4). Em um lançamento de moeda, um jogador pode se interessar mais pelo número de caras e menos pela sequência de caras e coroas. Esses resultados mais importantes são variáveis aleatórias, definidas como funções reais definidas em espaços amostrais.[22]

Em caso de transformações de variáveis aleatórias, as variáveis aleatórias são definidas como funções de variáveis aleatórias ou funções compostas. Seja uma variável aleatória em e uma função mensurável . Então, , em que é uma função mensurável em , também será uma variável aleatória em (a composição de funções mensuráveis é mensurável). O mesmo processo que permite ir de um espaço probabilidade para também pode ser usado para obter a distribuição probabilidade de . A função distribuição acumulada de pode ser definida como [22]

Seja uma variável aleatória real e seja . Então,

- Se , então . Logo,

- Se , então [22]

Essa probabilidade pode ser escrita como . [22]

Embora a primeira parcela seja , a segunda parcela é a distribuição acumulada menos a chance de ser igual a . Isto é, . Logo, [22]

Momentos[editar | editar código-fonte]

Os momentos dão informações parciais sobre a medida de probabilidade , a função distribuição acumulada ou a função massa de probabilidade de uma variável aleatória . Os momentos de são esperanças de potências de . O -ésimo momento da variável aleatória pode ser definido como , para qualquer inteiro não negativo , se a esperança existe.[23]

Equivalência de variáveis aleatórias[editar | editar código-fonte]

Há diferentes formas de afirmar se duas ou mais variáveis aleatórias são equivalentes. As variáveis aleatórias podem ser iguais, quase certamente iguais, iguais em distribuição e iguais na média, de acordo com as descrições em ordem crescente de força abaixo.[24]

Igualdade de distribuição[editar | editar código-fonte]

Duas variáveis aleatórias e são iguais em distribuição se

Para serem iguais em distribuição, as variáveis aleatórias não têm de ser definidas no mesmo espaço de probabilidade. O conceito de equivalência de distribuição é associado ao conceito de distância entre distribuições de probabilidade que é a base do Teste Kolmogorov-Smirnov.[24]

Igualdade de média[editar | editar código-fonte]

Duas variáveis aleatórias e são iguais na média de ordem se o momento de ordem de é 0,. Isto é, A igualdade na média de ordem implica a igualdade nas médias de ordem para todos os tais que . Como em igualdade de distribuição, existe uma distância entre as variáveis aleatórias [24]

Igualdade quase certa[editar | editar código-fonte]

Duas variáveis aleatórias e são quase certamente iguais se, e apenas se, a probabilidade de elas serem diferentes for 0. Isto é, Para todos os objetivos práticos da teoria da probabilidade, o conceito de igualdade quase certa é tão forte quanto o conceito de igualdade. Ele está associado a distância entre as variáveis aleatórias em que representa o supremum essencial em teoria da medida. [24]

Igualdade[editar | editar código-fonte]

Finalmente, duas variáveis aleatórias e são iguais em seu espaço de probabilidade se .[24]

Contra-exemplos[editar | editar código-fonte]

Os contra-exemplos mostram que a implicação inversa dos conceitos de equivalência de variáveis aleatórias nem sempre é válida. É o caso da igualdade de distribuição, mas não igualdade de média. Considerando o espaço amostral dos lançamentos de dois dados honestos e as variáveis aleatórias valor do primeiro dado e valor do segundo dado , observa-se que e são iguais em distribuição, mas não são iguais em média, pois e são independentes.[24]

Convergência[editar | editar código-fonte]

Em estatística, busca-se provar resultados convergentes para certas sequências de variáveis aleatórias como na lei dos grandes números ou no teorema do limite central. Em vários casos, a sequência de variáveis aleatórias podem convergir para uma variável aleatória .[25] Com exceção da convergência pontual, as convergências precisam de uma probabilidade.

Convergência em Probabilidade[editar | editar código-fonte]

Quando uma sequência de variáveis aleatórias é muito extensa. Por exemplo, mil variáveis aleatórias — diz-se que a quantidade de variáveis aleatórias é grande e que a probabilidade da diferença ser maior do que qualquer número positivo escolhido tende a zero. Seja uma sequência de variáveis aleatórias e uma variável aleatória definida no mesmo espaço de probabilidade. Então, diz-se que converge em probabilidade para . Isto é, para se .[26]

Convergência Quase Certa[editar | editar código-fonte]

Em um espaço de probabilidade , diz-se que uma sequência de variáveis aleatórias converge para uma variável aleatória quase certamente quando: .[26]

Convergência em Distribuição[editar | editar código-fonte]

Seja uma sequência de variáveis aleatórias . Ela irá convergir em distribuição para uma variável aleatória se: para qualquer função contínua e limitada, o que pode ser escrito como , em que é função de distribuição acumulada de e é função de distribuição acumulada de .[26]

Ver também[editar | editar código-fonte]

- Aleatoriedade

- Distribuição de probabilidade

- Evento

- Processo estocástico

- Variável aleatória discreta

- Variável aleatória contínua

Referências

- ↑ Azevedo Filho 2009, p. 90.

- ↑ a b c d e Farias, Ana Maria. «Aula 10 - Variáveis Aleatórias Discretas» (PDF). Universidade Federal Fluminense (UFF). p. 135. Consultado em 18 de outubro de 2016

- ↑ Blitzstein, Joe; Hwang, Jessica (2014). Introduction to Probability. Boca Raton: CRC Press

- ↑ Morettin, Luiz Gonzaga (1999). Estatística Básica. Volume I - Probabilidade. São Paulo: Makron Books. p. 42

- ↑ a b c Portnoi, Marcos (2010). «Probabilidade, Variáveis Aleatórias, Distribuição de Probabilidades e Geração Aleatória - Conceitos sob a ótica de Avaliação de Desempenho de Sistemas» (PDF). Universidade Salvador (UNIFACS). p. 9. Consultado em 18 de outubro de 2016

- ↑ a b Rêgo, Leandro Chaves (2014). «Notas de Aula do Curso - PGE950 Probabilidade» (PDF). Universidade Federal de Pernambuco (UFPE). p. 56. Consultado em 18 de outubro de 2016

- ↑ Rêgo, Leandro Chaves (2014). «Notas de Aula do Curso - Probabilidade» (PDF). Universidade Federal de Pernambuco (UFPE). p. 102. Consultado em 18 de outubro de 2016

- ↑ Lages, Walter Fetter (2004). «Probabilidade e Variáveis Aleatórias» (PDF). Universidade Federal do Rio Grande do Sul (UFRGS). p. 20. Consultado em 18 de outubro de 2016

- ↑ Crespo, Antônio Arnot (2002). Estatística Fácil. São Paulo: Saraiva. p. 127

- ↑ Yates, Daniel S.; Moore, David S. (2003). The Practice of Statistics. Nova Iorque: Freeman

- ↑ Castañeda, Liliana Blanco; Dharmaraja, Selvamuthu; Arunachalam, Viswanathan (2012). Introduction to Probability and Stochastic Processes with Applications. [S.l.]: Willey

- ↑ a b «Esperança de Variáveis Aleatórias». Portal Action. Consultado em 18 de outubro de 2016

- ↑ a b c d Casella, George; Berger, Roger L. (2010). Inferência Estatística. [S.l.]: Centage Learning. p. 26

- ↑ a b Braga, Luis Paulo Vieira (2008). «Introdução à Estatística» (PDF). Fundação CECIERJ. Consultado em 18 de outubro de 2016

- ↑ a b Peternelli, Luiz Alexandre. «Capítulo 4 - Funções de Distribuição de Variáveis Aleatórias» (PDF). Universidade Federal de Viçosa (UFV). p. 48. Consultado em 18 de outubro de 2016

- ↑ a b c Bussab & Morettin 2004, p. 128.

- ↑ a b c d e f Bussab & Morettin 2004, p. 162.

- ↑ a b Colcher, Sérgio. «Variável Aleatória» (PDF). Pontifícia Universidade Católica do Rio de Janeiro (PUC - Rio). p. 12. Consultado em 18 de outubro de 2016

- ↑ a b Lima, Juliana Sales de (2014). «Relação entre as Distribuições t de Student, Normal e Qui-quadrado» (PDF). Universidade Estadual da Paraíba (UEPB). p. 19. Consultado em 18 de outubro de 2016

- ↑ a b Sousa, André Luiz Cardoso de. «Variáveis Aleatórias Contínuas» (PDF). Universidade Estadual de Santa Catarina (UESC). p. 7. Consultado em 18 de outubro de 2016

- ↑ «Variáveis Aleatórias». Instituto de Matemática Pura e Aplicada (IMPA). Consultado em 18 de outubro de 2016

- ↑ a b c d e Ross, Sheldon (2010). Probabilidade - Um Curso Moderno com Aplicações. Porto Alegre: Bookman. p. 151

- ↑ Rêgo, Leandro Chaves (2014). «Nota de Aula do Curso - Probabilidade» (PDF). Universidade Federal de Pernambuco (UFPE). p. 70. Consultado em 18 de novembro de 2016

- ↑ a b c d e f Kreutz–Delgado, Kenneth (2008). «Basic Random Variable Concepts» (PDF). Universidade da Califórnia. p. 5. Consultado em 18 de outubro de 2016

- ↑ «Convergence of Ramdon Variables» (PDF). Instituto de Tecnologia de Massachusetts (MIT). 2008. p. 1. Consultado em 18 de outubro de 2016

- ↑ a b c Barbé, Philippe; Ledoux, Michel (2007). Probabilité. Les Ulis: EDP Sciences. p. 109

Bibliografia[editar | editar código-fonte]

- Azevedo Filho, Adriano (2009). Introdução à Estatística Matemática Aplicada. Volume I - Fundamentos. Scotts Valley: CreateSpace Publishers

- Bussab, Wilton de O.; Morettin, Pedro A. (2004). Estatística Básica. São Paulo: Saraiva

![{\displaystyle E[g(X_{n})]\to E[g(X)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/165f49a39fb42999ece0df6ba9ada8ddabc167e4)